- 会員限定

- 2016/09/05 掲載

今の時代、誰でも一度はAIを「自作」すべきだ

#MakerFaireTokyo2016 レポート

1962年東京生まれ。東京電機大学工学部卒業。産業用ロボットメーカーの研究所にて、サーボモーターやセンサーなどの研究開発に4年ほど携わる。その後、アスキー入社。週刊アスキー編集部、副編集長などを経て、2002年にフリーランスライターとして独立。おもにロボット、ネットワーク、エンタープライズ分野を中心として、Webや雑誌で記事を執筆。主な著書に『キカイはどこまで人の代わりができるか?』など。

AIの進展を加速させた3つの要因とテクノロジー

2015年度を振り返ると、誰もがAIの進化に驚かされた1年間だった。年頭には、画像認識の精度を高めるプロジェクト「IMAGNET」において、マイクロソフトとグーグルが人間の認識精度を抜く記録を出した。2016年3月には、まだ誰もが勝てないと予想していたプロ囲碁棋士との勝負で、(グーグル子会社のDeepMindが開発したAIの)AlphaGoが人を負かせてしまった。夢のテクノロジーが一気に躍進した年だったといえるだろう。

NVIDIAの矢戸知得 氏は「ディープラーニングの利用が加速されている理由には、「『ビッグデータ』『よりよいモデル』『強力なGPUアクセラレータ』という大きな要因がある」と指摘する。

現在、インターネットにつながる多くのデバイスからは、処理しきれない膨大なビッグデータが生まれている。さらに人を超える技術を実現するアルゴリズムやモデルが開発されている。これらのアルゴリズムを処理できる強力なアクセラレータの登場も大きい。NVIDIAが開発したGPUがその代表例だ。

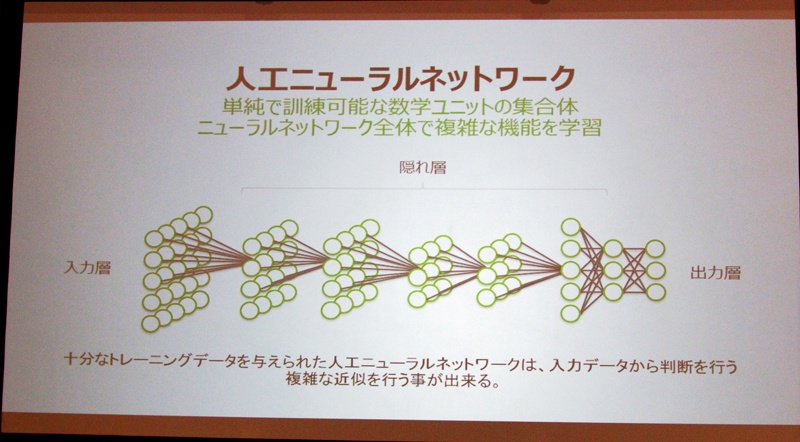

近年、AIが多くの分野に応用され始めたのは、巷で話題の「ディープラーニング」の存在が大きい。ディープラーニングは、人間の神経回路網をモデル化した人工ニューロンが何階層にもつながってネットワークを構成し、全体で複雑な機能を学習していく。つまり、訓練が可能な数学的なユニットを集め、膨大な入力データから高度な判断を行うわけだ。

同氏は、ディープラーニングによる特徴として、「ロバスト性(注1)」、「一般性」、「スケーラブル」の3点を挙げて説明した。

(注1)外的要因による変化を内部で阻止する仕組み

「従来までは、人が特徴量を設計し、ルールベースのプログラムで判断させていたが、それでは処理しきれないことも多かった。ディープラーニングでは、とにかく大量のデータをニューラルネットワークに与えて学習させ、自動的に特徴量を獲得していくことで、ロバスト性も発揮できる」(矢戸氏)

さらに同じニューラルネットワークのアプローチを、異なる多くのアプリケーションやデータに適用できる一般性を有している点も特徴の1つだ。データ処理面でも、大規模な並列処理を行うことで、スケーラブルにパフォーマンスを向上できるのだ。

個人でもAIを自作できるようになった

矢戸氏は、この状況に大きな可能性を見出しており、「個人でもAIによって面白いことを実現できる時代になった。そこで実際にメーカーズとして、オープンソースのAIソフトウェアを利用し、最先端のAI装置をつくることにチャレンジした」と語る。

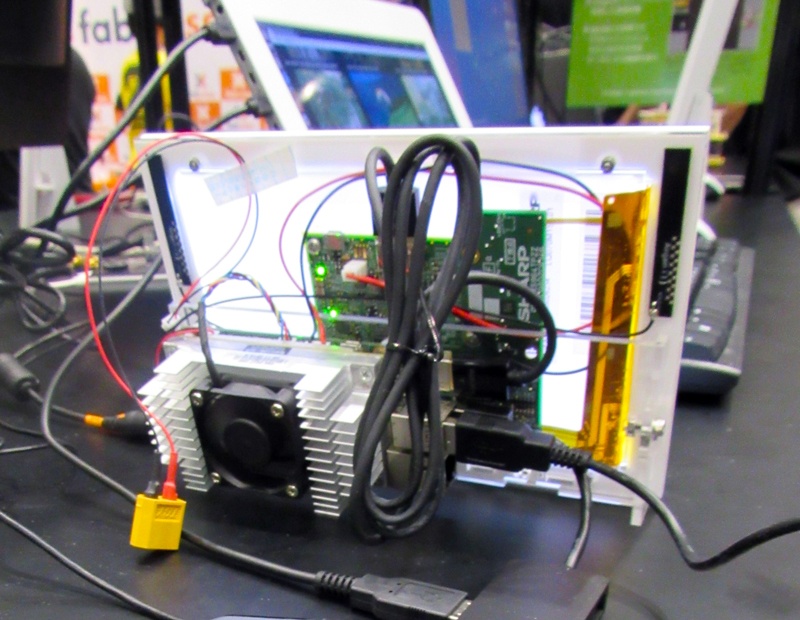

今回、同氏が製作したのは「Jetson AI(Video-to-Speech)デバイス」だ。NVIDIAのGPUを搭載した組込みボードを利用し、カメラからリアルタイムに映し出された画像をAIが理解しながら、その状況に説明文(キャプション)をつけるというものだ。

この装置の具体的な構成は「Jetson TX1モジュール」を中心とし、周辺機器にWebカメラやヘッドフォン、液晶パネルを採用。スタンドアローンで動作させるために、リチウムポリマーバッテリも搭載している。装置の詳細な内容についてはCQ出版の「Interface」(2016年7月号)に寄稿しているそうなので、興味がある方は文献を参照してほしい。

矢戸氏によれば、この実験のネタになったのは、TEDで公開されたスタンフォード大学のフェイフェイ・リー氏による講演とのことだ。

例えば3歳の女の子が写真を見て、「ネコ」「本」「イス」というように、モノを識別できるようになるまでには、膨大な経験を積み上げている。子供は誰かに教えられなくても、現実世界の経験を通じてモノを認識し、その見方を身に着けているのだ。

カメラである「目」が、200ミリ秒ごとに写真を撮っていると仮定すれば(目が動く平均時間)、すでに3歳までに何億枚もの写真を見ていることになる。ディープラーニングの発想は、子供が経験を通じて受ける大量の訓練データを、アルゴリズムへ与えて学習させていることと同じ作業だといえる。

フェイフェイ・リー氏らの研究により、ディ-プラーニングで、そのモノが何であるかを自然言語で説明し、さらに位置関係や背景まで把握できるようになった。このAIの実装方法は、ネットでも論文が公開されている。

「もし我々が個人でディープラーニングの実験を行う際には、一から全部を用意する必要はない。すでに多くのディープラーニングのフレームワークなどや、モデル(コンピュータビジョン、ボイス&オーディオ、自然言語処理など)が用意されているからだ。これらを使って、その上でアプリケーションを開発すればよい」(矢戸氏)

【次ページ】自作AIはどこまで正確に画像を認識できるか

関連タグ

PR

PR

PR