- 会員限定

- 2026/04/12 掲載

【エヌビディア1強打破へタッグ】インテルとグーグルがAIインフラ協業を拡大

AIデータセンター専用半導体IPUの共同開発

インテルとグーグルがAIインフラ分野でタッグ

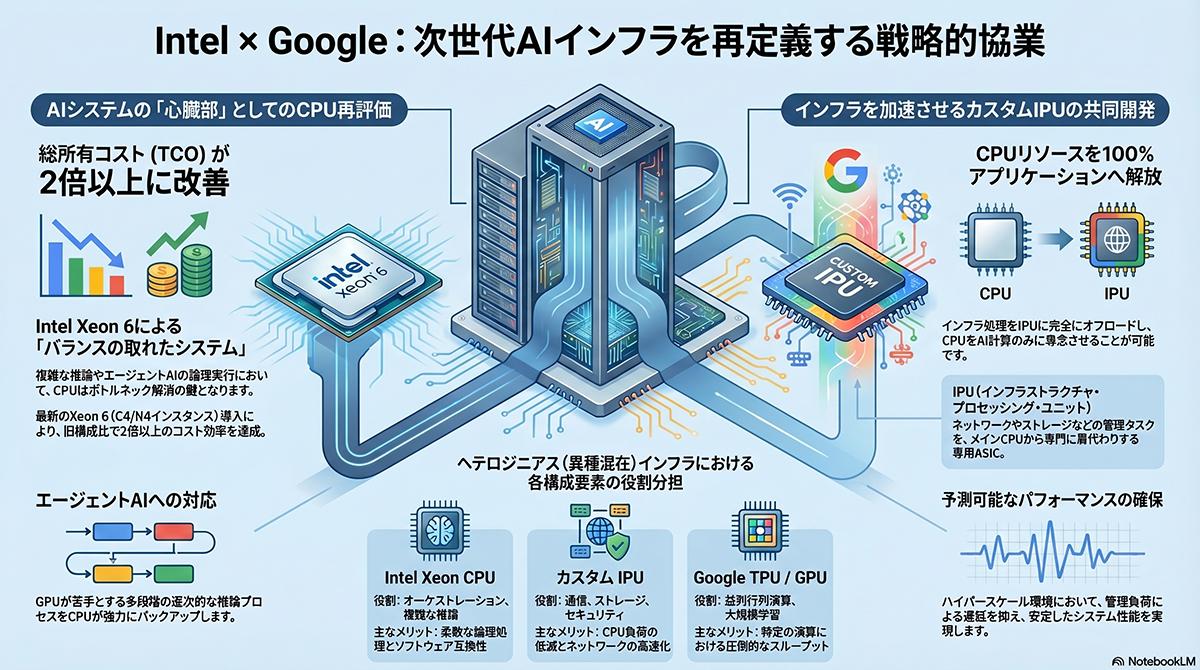

米IntelとGoogleによる今回の協業は、急増するAIワークロードに対応するためのインフラストラクチャ強化を目的としている。Google Cloudは、AIモデルのトレーニングや推論、汎用コンピューティング向け基盤として、Intelの最新世代CPUであるXeon 6プロセッサを引き続き採用する。同プロセッサはすでにGoogle CloudのC4およびN4インスタンスに導入済みである。協業のもう一つの柱として、両社はカスタムASICを用いたIPUの共同開発を拡大する。IPUは、これまでホストCPUが処理していたネットワーク、ストレージ、セキュリティなどのインフラ管理機能をオフロードする専用ハードウェアである。大規模なハイパースケールAI環境においてIPUを活用することで、ホストCPUの利用効率を極限まで高め、より予測可能で安定した性能を実現する。

IntelのCEOであるリップブー・タンは、AIの拡張には特定のアクセラレータへの依存を減らし、システム全体のバランスを取る設計が必要であると言及した。GoogleのAIインフラストラクチャ担当最高技術責任者であるアミン・ヴァダットも、AIシステムの基盤におけるCPUとIPUの連携を重視し、Intelの技術ロードマップへの支持を表明している。

これまでAIインフラ市場ではGPUを中心としたアクセラレータ主導の開発が先行していたが、両社は汎用コンピューティングと専用インフラを組み合わせたヘテロジニアス(異種混在)アーキテクチャへのシフトを進めている。システム全体のリバランスを図ることで、企業や開発者に向けた次世代AIクラウドサービスの基盤を強化し、オープンで拡張性の高いインフラの普及を推進する。

Nvidiaが過半のシェアを握るAIチップ市場において、IntelにとってGoogleとの連携拡大はデータセンター領域における巻き返しの要となる。Google側にとっても、約30年前の自社サーバー構築時から続くIntelとの協業を軸に、膨張するデータセンターの電力消費と運用コストを劇的に抑える狙いがある。AIインフラ競争のステージが移行する中、CPUを中心としたシステム全体の連携構築が改めて問われている。

今すぐビジネス+IT会員に

ご登録ください。

すべて無料!今日から使える、

仕事に役立つ情報満載!

-

ここでしか見られない

2万本超のオリジナル記事・動画・資料が見放題!

-

完全無料

登録料・月額料なし、完全無料で使い放題!

-

トレンドを聞いて学ぶ

年間1000本超の厳選セミナーに参加し放題!

-

興味関心のみ厳選

トピック(タグ)をフォローして自動収集!

半導体のおすすめコンテンツ

PR

PR

PR