- 会員限定

- 2026/04/09 掲載

Anthropic、次世代TPUでGoogleおよびBroadcomと電撃提携

グーグル TPU採用で約3.5ギガワットの計算能力確保

Anthropicが、GoogleのTPUで約3.5ギガワットの計算能力を確保

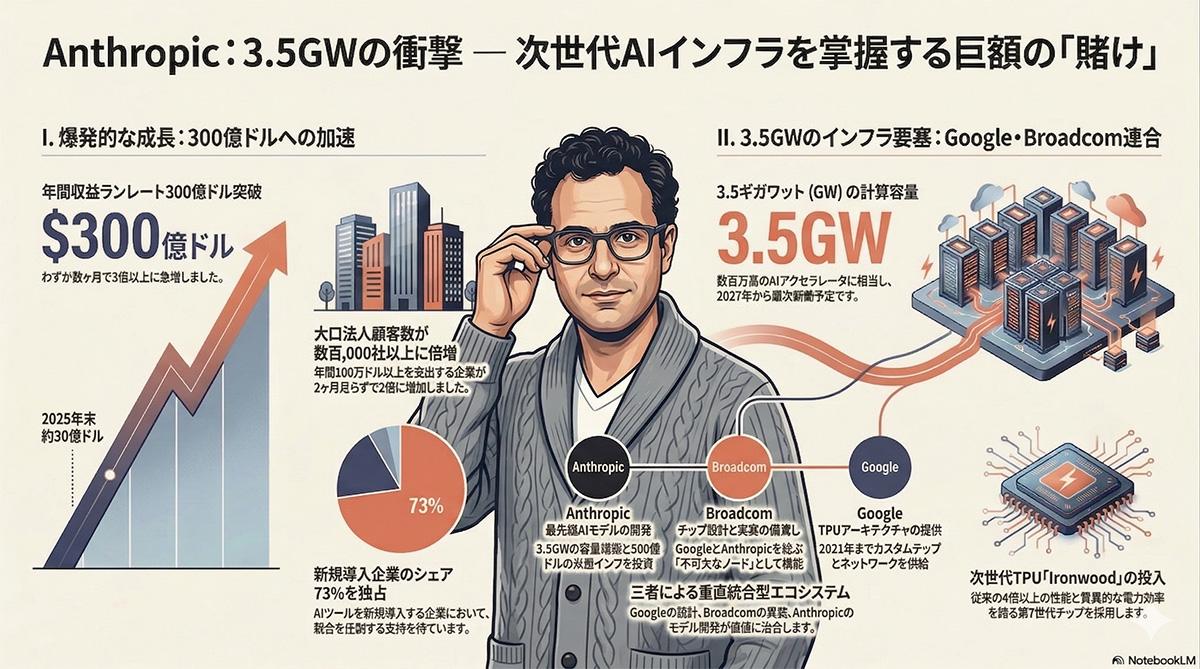

Anthropicの公式発表や米証券取引委員会(SEC)への提出文書によると、新たに確保する大規模な計算資源の大部分は米国内のデータセンターに設置される。複数のITメディアや金融メディアは、このTPU確保にかかる契約規模が210億ドル相当に上ると報じている。Anthropicの年間換算売上高は2025年末の約90億ドルから足元で300億ドルを突破した。年間100万ドル以上を支出する法人顧客数も短期間で1000社を超え、企業向けAIサービスの提供において計算需要が急激に増加している。

この提携はAIインフラの各階層を担う3社の役割分担によって成立している。Googleが基盤インフラとクラウドアーキテクチャを提供し、Broadcomが次世代TPUの設計およびネットワーク実装を担う。BroadcomとGoogleは2031年まで次世代TPUとネットワークコンポーネントを設計・供給する長期契約を結んでおり、今回のインフラ拡充もこの枠組みを活用している。

Anthropicは確保した計算能力を消費し、高度な推論能力を持つフロンティアモデルの開発を推進する。同社のCFOであるKrishna Rao氏は、このインフラ投資が顧客基盤の指数関数的な拡大に対応するための施策であると説明している。

他社が複数の半導体メーカーやクラウド事業者に計算負荷を分散させるアプローチを採用する中、AnthropicはGoogleのTPUを中心とした単一のハードウェアアーキテクチャに統合する戦略をとった。ハードウェアとソフトウェアの最適化を進めることで、重要業務をClaudeに依存するエンタープライズ顧客に対して高いパフォーマンスとシステムの回復力を継続的に提供する体制を固める。

熾烈を極めるAIカスタムチップ競争、NVIDIA一強打破の流れも

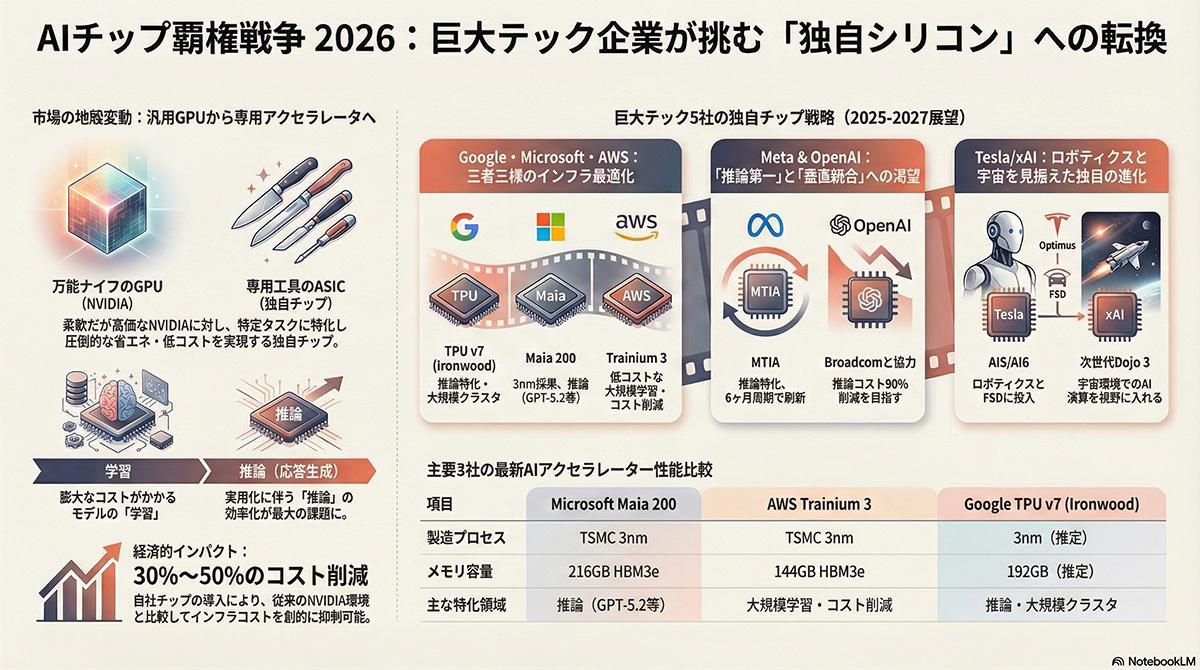

こうしたAnthropicの動きに代表されるように、AI半導体市場では、ハイパースケーラーによる独自チップ開発競争が加速している。グーグル、マイクロソフト、アマゾン、メタ、オープンAI、テスラ(xAI)といった巨大テック企業は、高騰する汎用GPUの調達コスト削減と自社モデルへの最適化を目指し、垂直統合型のインフラ戦略を強化している。グーグルは、実績のある独自AI半導体「TPU」の第7世代「Ironwood」を投入し、アンスロピックとの210億ドル規模とされる提携を通じて大規模な計算資源を確保した。マイクロソフトは推論特化型チップ「Maia 200」を公開し、自社クラウドとの統合により高い費用対効果を追求している。アマゾンは「Trainium」や「Inferentia」の次世代機開発を継続し、メタも「MTIA」シリーズを6カ月間隔で更新する強気なロードマップを掲げ、推論ワークロードの自社化を急いでいる。また、オープンAIは「Titan」の開発に着手し、テスラは「Dojo」プロジェクトを通じて自動運転モデルの学習効率向上を狙う。

この独自チップへの転換期において、NVIDIAのGPU一強であった市場から、カスタムチップの設計や実装を支援するベンダーの存在感が増している。ブロードコムはグーグルのTPU開発における長年のパートナーであり、メタやオープンAIの独自チップ設計も主導するなど、AIインフラの重要な担い手として台頭している。マーベル・テクノロジーは、膨大な数のチップを連携させるインターコネクト技術や光通信分野で強みを発揮し、アマゾンやマイクロソフトのカスタムプログラムに不可欠な存在となった。各社はエヌビディア製品の調達も並行して進めているが、特定の用途に特化した「ソブリン・シリコン」への投資を拡大しており、半導体エコシステムは特定の単一ベンダーに依存しない多極化の時代へと突入している。

AI・生成AIのおすすめコンテンツ

AI・生成AIの関連コンテンツ

PR

PR

PR