- 会員限定

- 2026/03/31 掲載

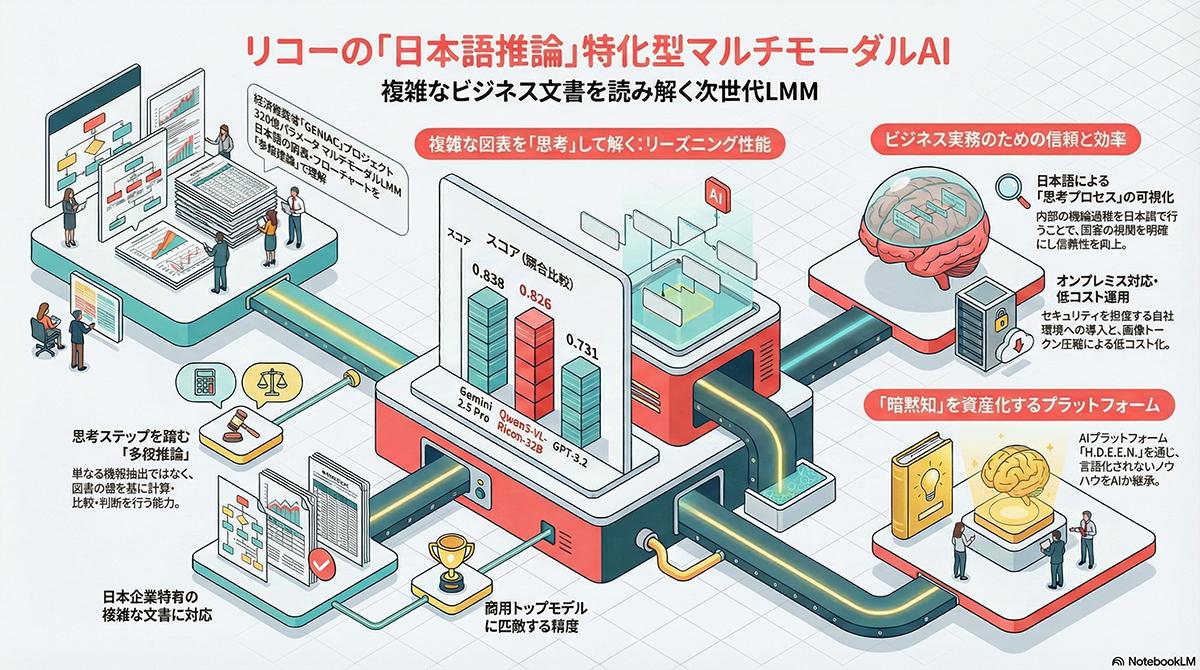

リコー、日本語推論特化のマルチモーダルAIモデルを発表

独自の強化学習によりGemini 2.5 Proに匹敵する性能を達成

開発のベースには、中国のアリババクラウドが提供するAIモデル「Qwen3-VL-32B-Instruct」が採用された。リコーはこれを基に、特定のタスクに最適化する教師あり微調整を施した上で、カリキュラム学習や強化学習といった複数の学習手法を取り入れた。

特に強化学習のプロセスにおいては、最終的な出力の正確さに加え、推論のプロセスを適切に日本語で出力するかどうかを評価する独自の報酬関数を設定した。一連の最適化により、モデルが複数のステップを経て論理的な思考を行い結論を導き出すリーズニング性能を獲得した。

同時に、AIがどのような思考過程や前提条件に基づいて回答したのかを日本語で確認できるようになったことで、ビジネス現場における実務利用の信頼性を高めている。図表を含む日本語文書の読解性能を検証するベンチマークテストにおいては、米グーグルの「Gemini 2.5 Pro」など大型の商用モデルと同水準のスコアを記録している。

また、リコーは同日、開発に用いた技術を活用した80億パラメータの軽量版モデル「Qwen3-VL-Ricoh-8B-20260227」を開発プラットフォームであるHugging Face上で無償公開した。今回開発された320億パラメータの基本モデルは、セキュリティやデータ保護の観点から社内専用環境での運用を希望する企業向けに、オンプレミス環境での導入を想定した設計となっている。

今後は、リコー独自のAIプラットフォーム「H.D.E.E.N」や、AIモデルを搭載した専用のサーバーパッケージ等を通じて提供される見通しである。加えて、AIモデルが処理する画像トークンを圧縮して削減する独自技術なども開発されており、これらを用いて企業側のAI運用コストを抑える取り組みも進められている。

AI・生成AIのおすすめコンテンツ

AI・生成AIの関連コンテンツ

PR

PR

PR