- 会員限定

- 2026/03/31 掲載

ガートナー流、生成AIの安全活用を実現する「4つの戦術」…有効なツールも解説

不正なAIトランザクションの多数を占める「ある割合」

まず、ジャオ氏は「AIというのは日本ではまだ広範囲に使われていないと聞いていました。しかし今回、多くの方とお会いして、かなり進んでいる、新しいテクノロジーを先に行こうという意思を感じました。セキュリティリーダーとしては、まず堅牢な基盤整備が出発点となります」と説明した。ジャオ氏によると、そこで重要となるのが「AI TRiSM(AIトラスト・リスク・セキュリティ・マネジメント)」である。AI TRiSMとは、ガートナーが近年定義した概念だ。AIモデルやアプリケーションを放置すれば重大なリスクが生じかねない。AI TRiSMはそうしたリスクを能動的に特定・軽減し、確実性・信頼性・セキュリティを担保するフレームワークを指す。

また、ガートナーの予測では「2026年末までに不正なAIトランザクションの少なくとも80%は、外部攻撃ではなく、情報の過剰共有や不適切利用、誤ったAIの振る舞いに関する社内ポリシー違反から発生する」とされている。ジャオ氏は、最大のリスクは外部のハッカーではなく内部に存在すると指摘した上で、教育、ポリシー策定、そして監督体制の強化が不可欠だと話す。

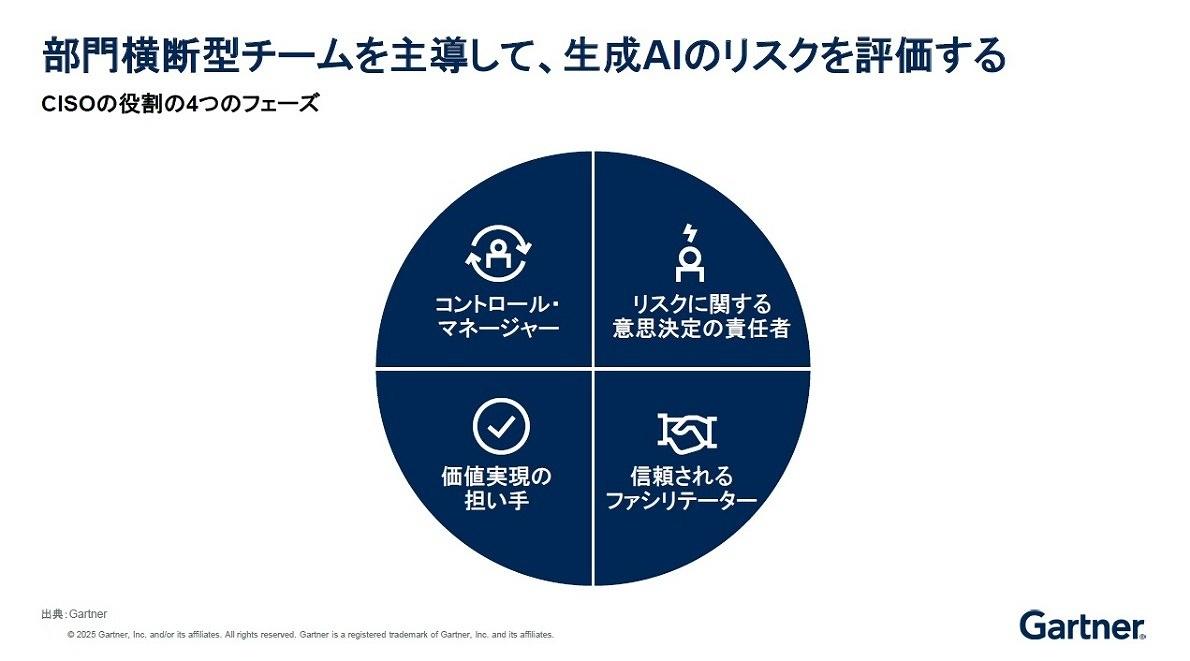

さらにジャオ氏は、生成AIには「不透明なガバナンス」「膨大なビジネスニーズ」「ツールごとに異なる価値」「新たなアタックサーフェス」「明確な評価指標の欠如」という5つの主要な課題があると指摘。「これらの課題に対応する戦術を講じ、セキュアでイノベイティブなAIドリブン未来に備えることが、今まさに私たちに求められているのです」と強調する。では、その戦術とは、具体的に何を指すのだろうか。 【次ページ】戦術1:まず意識したい「連携戦術」とは

AI・生成AIのおすすめコンテンツ

AI・生成AIの関連コンテンツ

PR

PR

PR