- 2025/12/29 掲載

OpenAI、年収8000万円超で「AIリスク」の責任者ポジションを募集

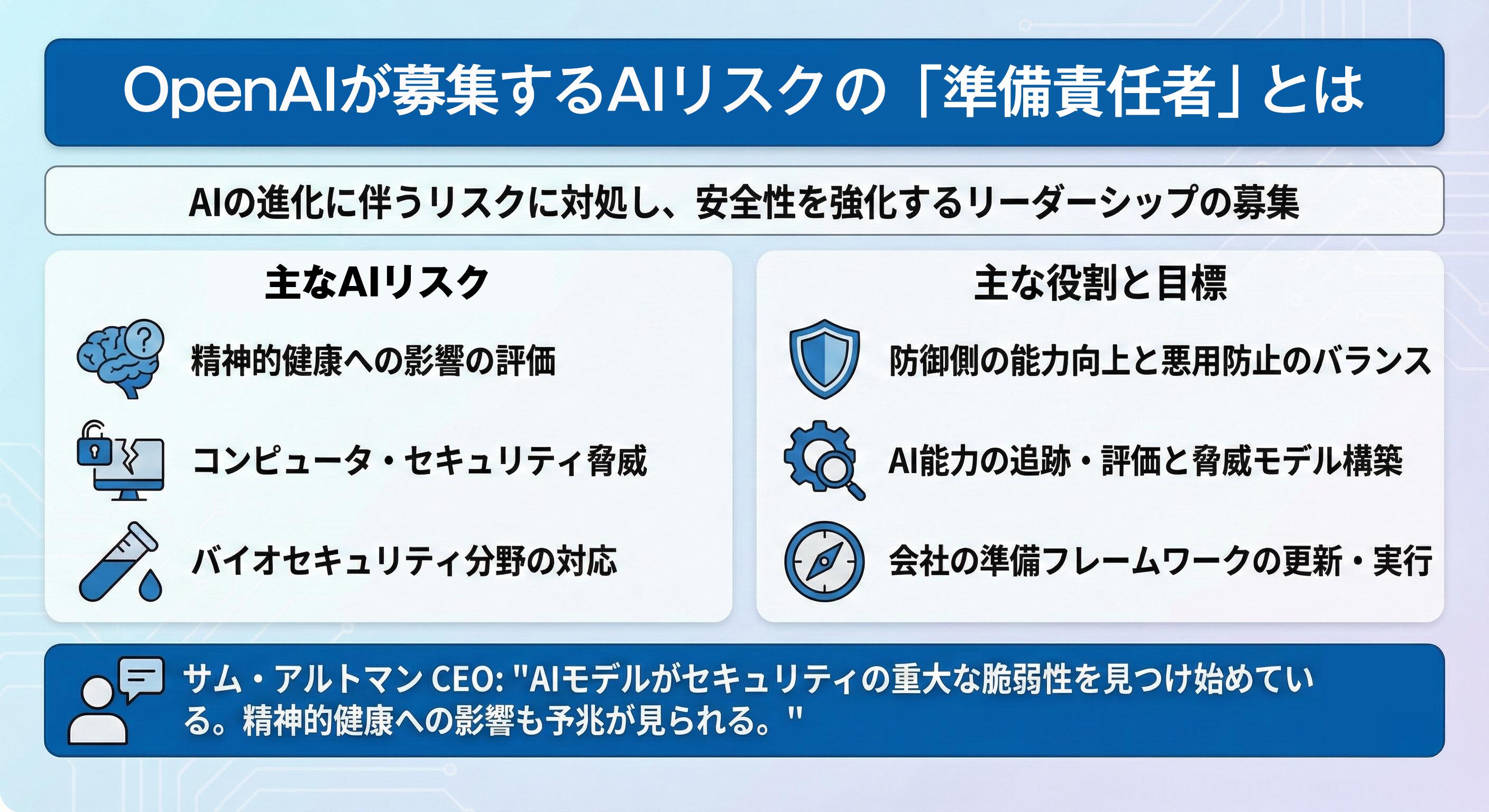

セキュリティリスクやメンタルヘルスへの影響など「AIリスク」を評価・対応する責任者

職務内容には、能力評価や脅威モデルの構築、緩和策の設計・調整といったリスク対応戦略の策定・実行が含まれ、技術的な安全パイプラインの確立を主導することが求められている。募集情報には応募方法や具体的な勤務条件も記載されている。

OpenAIによれば、このポジションに提示されている報酬は年間最大約55万5千ドル(約8000万円超)および株式報酬とされており、セキュリティやAIによる新興リスク管理の責任者としての重責を反映した条件となっている。

アルトマンは求人投稿の中で、この役割が「ストレスフル」であるものの、現代のAI開発におけるリスク対応に不可欠だと述べ、サイバーセキュリティ上の脆弱性発見や自己改善するシステムの安全性確信までも含めた広範なリスクに対応する意図を明示している。

職務内容に含まれるリスク領域について、報道ではAIのサイバーセキュリティ脅威への対応だけでなく、AIチャットボットなどの利用が精神的な健康や行動に与える影響といった社会的リスクも取り上げられている。

サム・アルトマンは求人投稿で、モデルがコンピュータの脆弱性を発見しうる段階に至っている点や、ユーザーがAIとの対話をセラピー代わりに用いるケースが精神健康上の懸念を生んでいると指摘しており、メンタルヘルスへの配慮も同職の対象だと説明している。

OpenAIはこれまで「Preparedness Framework」を通じて危害リスクの評価や安全性担保の仕組みを内部で整備してきたことを公式に開示している。

このフレームワークはAIシステムの能力に応じてリスクを分析し、展開前に安全性対策の評価や外部のレッドチーム評価などを行い、深刻な危害の可能性を最小限にすることを目的としている。OpenAI自身が公開している情報では、サイバーセキュリティ、選挙関連の誤情報リスク、バイアスや偏向表示など複数の安全検証プロセスが含まれているとされる。

一方、外部ではOpenAIの安全性戦略やリスク評価プロセスについても評価や分析が進んでいる。専門家コミュニティの一部では、フレームワークが実際のリスク軽減策を担保しているかという点で議論があり、業界全体での透明性や外部ガバナンスの必要性が指摘されている。こうした背景の下で、リスク管理責任者ポジションの設置は企業としての安全責任を果たすだけでなく、外部からの信頼確保にも資する取り組みとして位置づけられる。

今回の募集は、AIの進化が生み出す脆弱性や社会的影響に対応する企業内ガバナンス強化の一環であり、AI開発企業が技術革新とリスク管理を両立させる取り組みの象徴的な事例となっている。

AI・生成AIのおすすめコンテンツ

AI・生成AIの関連コンテンツ

PR

PR

PR