- 2026/02/25 掲載

米Anthropic、中国AI企業3社による大規模な「蒸留攻撃」を報告

AIモデルの出力結果や推論プロセスを大量に取得、自社のモデルの訓練データとして盗用する手法

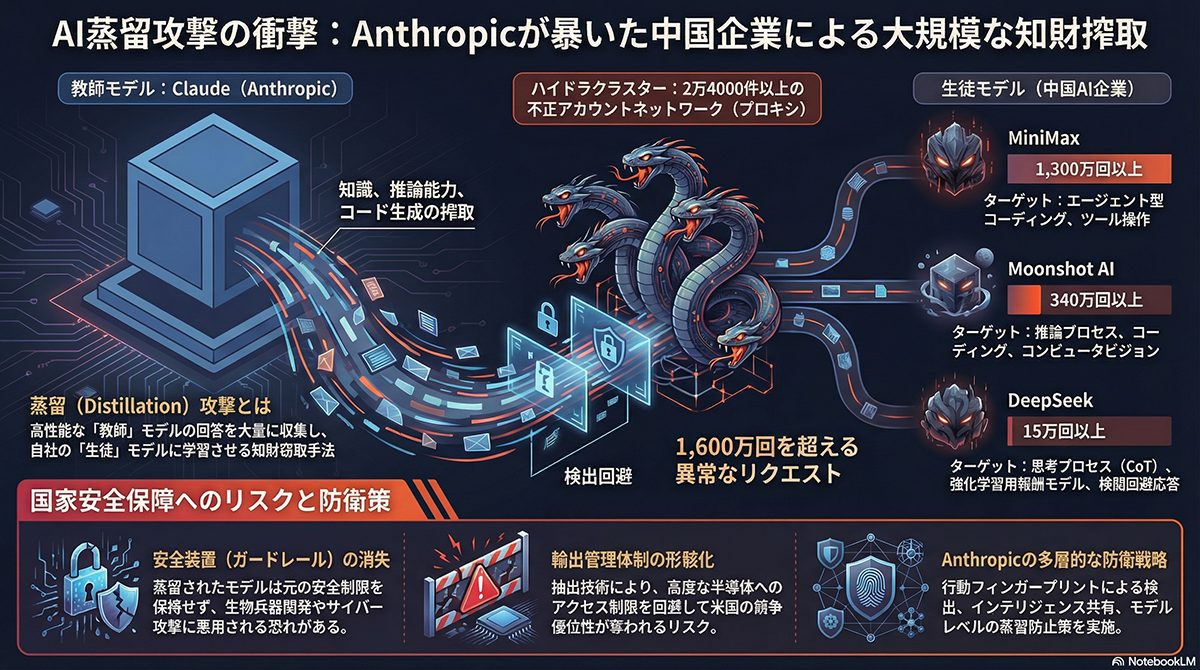

Anthropicの報告によると、これら3社は同社の利用規約および中国からのアクセスを制限する地域的ブロックを意図的に回避した。具体的には、商用のプロキシサービスや非公認の転売業者を利用して身元を偽装し、約2万4000件の不正アカウントのネットワークを構築した。そして、Claudeに対して1600万回以上に及ぶプロンプト送信を実行し、モデルの能力を抽出した。

抽出されたデータには、Claudeが複雑な問題を解決する際の内部的な論理的思考プロセスをステップバイステップで書き出させたものが含まれる。また、自社の強化学習プロセスにおいてClaudeを評価者として無断利用し、人間の専門家による評価コストを代替する目的でも悪用された。さらに、中国の検閲ルールを遵守しつつ高品質な回答を生成するためのデータ収集も確認されている。

同様の被害はOpenAIに対しても行われている。OpenAIは米下院特別委員会への資料において、DeepSeekなどがプログラムを用いた自動抽出手法やサードパーティルーターによる難読化を駆使し、継続的なデータ抽出を行っていると報告した。これらは合成データの生成や強化学習スタイルの最適化を組み合わせた多段階のパイプラインに進化している。

これに対し、DeepSeek側は自社の技術論文において、モデルの事前学習にはWebページや電子書籍のみを使用し、合成データは意図的に組み込んでいないと主張している。ただし、収集したWebデータ内に他社の強力なモデルが生成したテキストが大量に含まれていたことは認めている。

米国企業側は一連の行為を偶発的なデータ混入ではなく、高度に組織化された意図的な技術盗用であると非難している。Anthropicは、APIトラフィックから攻撃パターンを識別する分類システムを構築するなどの防衛策に多額の投資を行いつつ、業界全体や政策立案者に対して、国家安全保障上の懸念と技術流出のリスクに向けた協調的な対応を強く呼びかけている。

AI・生成AIのおすすめコンテンツ

AI・生成AIの関連コンテンツ

PR

PR

PR