- 2026/04/04 掲載

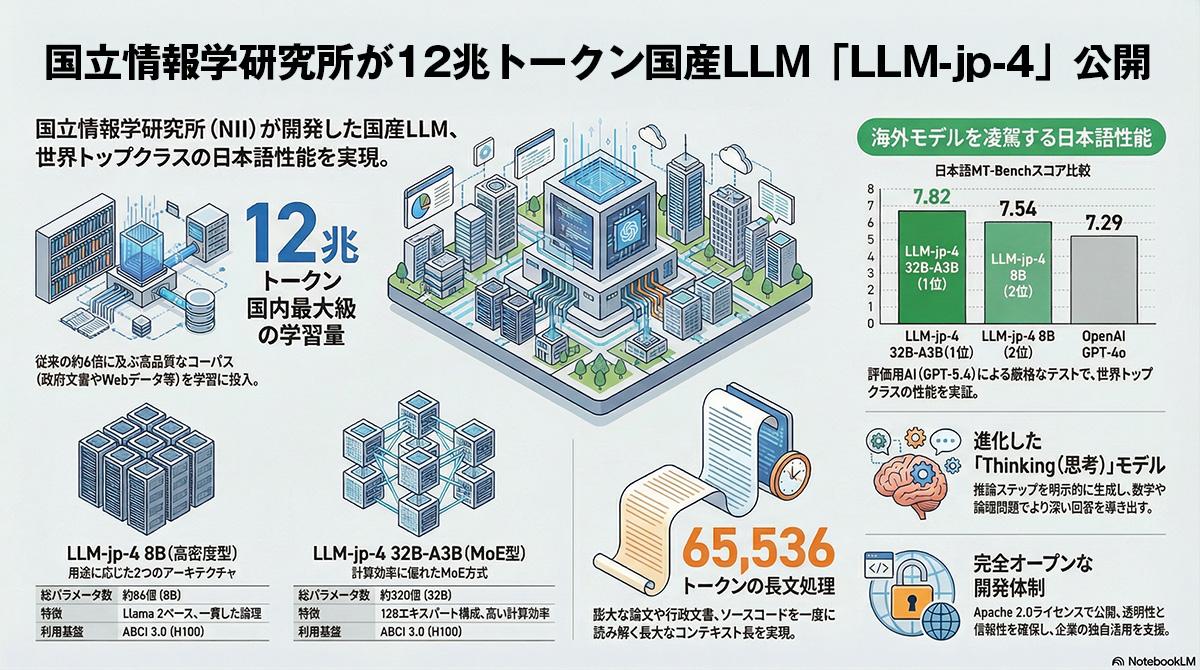

NIIが12兆トークン国産LLM、日本語性能でGPT-4o越え

オープンモデルとして米OpenAIのgpt-oss-20bを上回る性能

性能評価には既存の言語資源に基づき42種類のタスクを横断的に測定する独自の仕組みが用いられた。評価の結果、公開された両モデルは日本語の理解や生成能力において、米OpenAIが提供するオープンモデル「gpt-oss-20b」や中国のAlibabaのAIモデル「Qwen3-8B」など海外の有力な多言語対応モデルの性能と同等またはそれらを上回る水準を記録した。英語の理解性能を測る国際的な指標でも高い数値を達成しており、言語を問わず高精度な処理が可能である事実を示している。

今回の開発は、国立情報学研究所の大規模言語モデル研究開発センターを中心に大学や企業の研究者らが組織横断で参加するプロジェクトによる成果である。同プロジェクトは生成AIの基盤となるモデルの透明性や信頼性を確保することを目的に、開発プロセスや学習データを広く共有する方針を採っている。今回も第三者が入手可能なデータの収集と選別を行い、オープンソースAIの定義に配慮する形で構築されたデータセットをモデルと同時に公開した。モデルが何を学習して出力結果を導き出しているのかという過程を検証できる環境を整え、研究者や企業の独自のAI開発を後押しする。

同研究所は今後、開発したモデルを活用して生成AIの挙動原理の解明やデータバイアスの抑制に向けた研究を進める。さらに2026年度中にはよりパラメータ数の多い大規模モデルや、実際の業務システムに組み込んで運用しやすい軽量モデルを順次開発して公開する計画を明らかにしている。開発の拠点となるセンターではスーパーコンピューターなどの大規模な計算資源を確保しながら、国内における研究開発の拠点機能を持たせる。特定の海外企業への依存を減らし、国産の大規模言語モデルの技術力を高めることで、日本の産業競争力の強化や社会課題の解決を目指す。

AI・生成AIのおすすめコンテンツ

AI・生成AIの関連コンテンツ

PR

PR

PR