- 2026/03/06 掲載

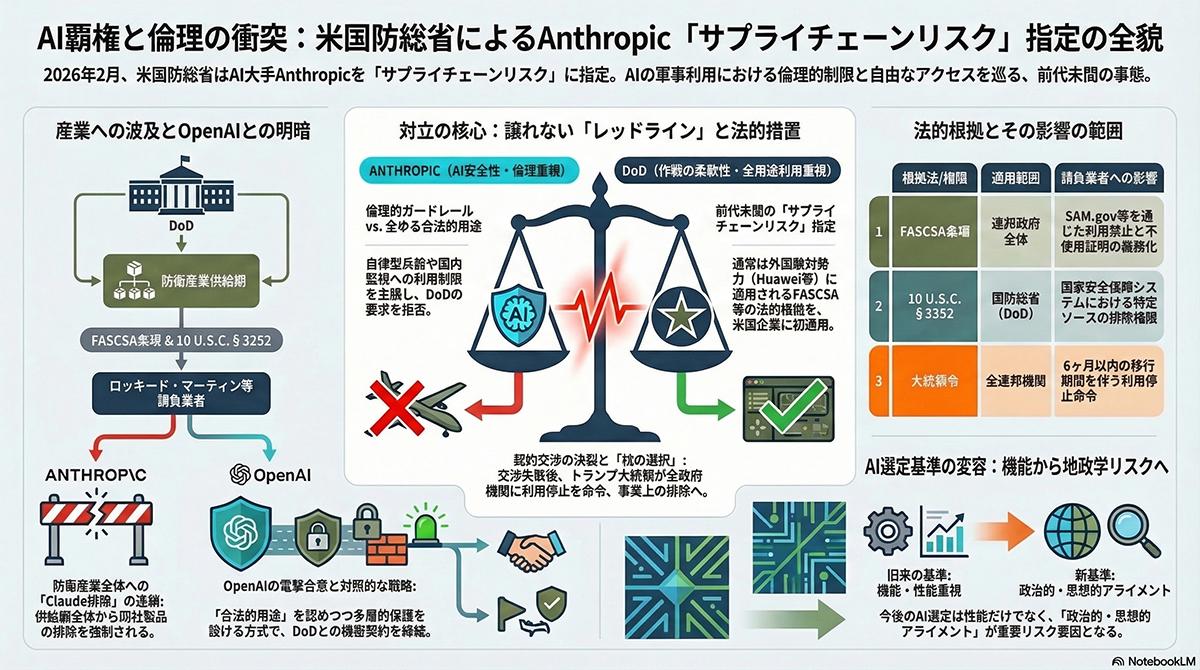

米国防総省がAnthropicを「サプライチェーンリスク」に指定

米軍と取引のある請負業者に同社との商業活動を行わないよう指示

この指定は即時発効しており、米国企業に対して公に適用されるのは史上初の事例となる。事の発端は、国防総省がAI企業に対し、軍によるあらゆる合法的な利用に同意するよう安全対策の撤廃を求めたことにある。

Anthropicは、米国民の大規模な国内監視および人間の判断を完全に排除した完全自律型兵器へのAI利用について、重大な危険をもたらすとして例外とするよう求めていた。同社のダリオ・アモデイCEOがこの要求を公式に拒否した翌日、トランプ大統領は同社を批判し、政府機関での同社製品の即時使用停止を命じた。

Anthropic側は、国防長官にそのような法的権限はないとして、この措置を不当とし法廷で争う姿勢を明らかにしている。この決定を受け、米国の防衛産業界ではAnthropicのAIモデルである「Claude」の利用を見合わせる動きが急速に広がっている。

ロッキード・マーティンは大統領と国防総省の指針に従い、同モデルの使用を中止する方針を示した。また、国防総省と大規模な契約を持つパランティアにおいても、自社プラットフォームの基盤として使用していた同社の技術を置き換える必要に迫られている。こうした状況のなか、Anthropicの競合である米OpenAIは、自社のAIモデルを国防総省の機密ネットワークに導入する契約に合意したと発表した。

OpenAIもAnthropicと同様に監視や自律型兵器への利用を制限する独自のレッドラインを設けていたが、モデルの提供をクラウド環境に限定し、自社の安全対策を維持し続けるという保護措置を講じることで合意に至った。OpenAIのサム・アルトマンCEOは、国防総省に対して他社にも同じ条件を提示するよう求めていると述べ、事態の沈静化を促している。

AI・生成AIのおすすめコンテンツ

AI・生成AIの関連コンテンツ

PR

PR

PR