- 2025/11/26 掲載

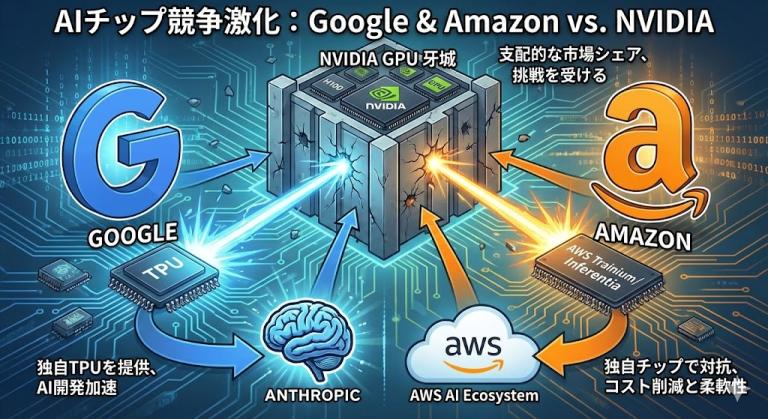

GoogleがAnthropicに独自AIチップを提供へ、NVIDIAの牙城を崩せるか?

Amazonも独自AIチップを軸に動いており、AIインフラ半導体戦争が過熱

ビジネス+IT

この動きを受けて市場では、Googleが自社AIチップを他社にも提供することで、長年支配的だったNVIDIAのGPU依存構造に揺さぶりをかけているとの観測が強まっている。

GoogleがNVIDIA以外のプラットフォームで大規模モデルを訓練できるという示唆が出たことで、NVIDIA以外のチップ供給者にも関心が集まっているとの指摘もある

一方、Amazonも自社チップ「Trainium」シリーズをAI学習用途の基盤として強化しており、特に第2世代Trainium(Trainium 2)や次世代Trainium 3(計画中)に対して投資と提供拡大を図っている。

Amazonのクラウド部門であるAmazon Web Services(AWS)は、1 四半期ごとに150%成長しているという報道もあり、その背景には「Trainiumを数百万枚規模で導入予定」という発言もある。

技術的には、こうした「カスタムAIチップ(アクセラレータ)」とは、AIモデルの学習や推論に特化して設計されたASIC(特定用途向け集積回路)あるいはチップレット構成を取るもので、一般的なGPUに比べて電力効率やコスト最適化を狙っている。たとえば、Trainium2は1パッケージに2ダイ(チップレット)構成を採用し、メモリ帯域やスパース演算対応を強化しているという報道もある。

それに対してNVIDIAの強みは、ハードウェアだけでなく、ソフトウェア(CUDA・エコシステム)と豊富な導入実績が揃っている点である。

こうした背景を受けて、今回の動きがもたらす影響・メリット・課題・懸念点には以下のようなものがある。まずメリットとして、クラウドサービス事業者が自社チップを確保・開発することで、外部サプライヤーへの依存度を下げ、コスト削減や差別化を図れる可能性がある。例えばAWSは「GPUの高コスト・入手性の課題」に対抗する目的でTrainium開発を開始したという報道もある。また、競争が強まることでチップ性能や効率が向上し、AIモデルの訓練・運用コストが低下する可能性がある。

しかしながら、課題や懸念点も少なくない。まず、AmazonのTrainiumは一部スタートアップ顧客から「NVIDIAのH100などに比べて性能・アクセス性・信頼性で劣る」という評価が出ており、実績面での課題が指摘されている。また、NVIDIAのエコシステムの壁は厚く、ソフトウェア・開発環境・導入実績という点で追随するのは容易ではない。 さらに、チップ開発には製造拠点・微細化プロセス・大量生産スケーラビリティといったハードルがあるため、新規勢力が短期間で独走状態を崩すのは簡単ではない。

産業・社会・ビジネス領域へのインパクトとしては、まずクラウドサービス業界での競争構図が変化してきている。従来、多くの生成AIモデルや学習基盤はNVIDIAのGPUに依存していたが、GoogleやAmazonが自社チップを活用・提供し始めたことで、クラウドインフラ事業者の戦略が「チップ開発・垂直統合」へとシフトしつつある。これにより、AI年齢の次の波では「サービス+ハードウェア」両軸での競争が重視される可能性がある。また、AIを活用する企業側にとっても、チップ・計算リソースの選択肢が増えることは、コスト低減やベンダーロックイン回避という観点で利点がある。社会的には、AIインフラの多様化が進めば、単一サプライヤー依存によるリスク(例えば供給制約・価格高騰)が緩和される可能性がある。

今後半年から数年先の展望としては、まず2026年には今回報じられたTPU100万個級の稼動や、AmazonもTrainium 3(3nmプロセス世代)の商用提供へ向けた動きが焦点となる。Google・Amazonともに「自社チップ+クラウドサービス+大規模AIモデル訓練」という統合的な戦略を加速させる可能性が高い。加えて、NVIDIAも自らクラウド・データセンターパートナーと提携・投資を拡大しており、競争は一層激化が予想される。

また、AIチップの性能向上・電力効率改善・専用開発環境(SDK・ソフトウェア)整備が進むことで、現在はGPU一強の構図に綻びが出る可能性もある。とはいえ、多くのアナリストは「NVIDIAが直ちに崩れるわけではない」とも指摘しており、今後数年は競争の“序章”と言える状況が続くと見られている。

AI・生成AIのおすすめコンテンツ

AI・生成AIの関連コンテンツ

PR

PR

PR