- 2026/01/26 掲載

Microsoft「触覚」認識を持つ、初のロボティクスAIモデル「Rho-alpha」を発表

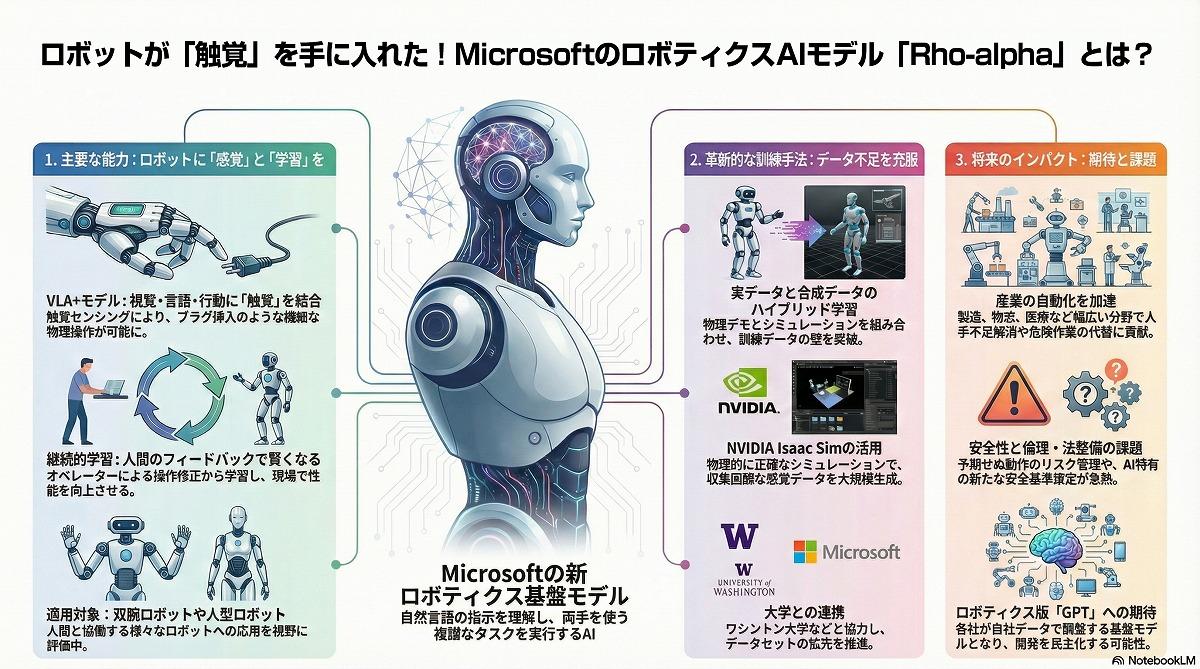

自然言語理解・視覚認識に「触覚」センシングを統合、ロボットが物理世界で複雑な操作を実行する能力を高めることを目的

トレーニングには、物理実世界でのデモンストレーションデータや、シミュレーション上で生成された軌道データ、Web規模の視覚言語データが活用されている。また、合成データ生成用にNVIDIA Isaac Simなどのシミュレーションフレームワークも用いられている。こうした手法により、触覚情報を含む大規模データセットの不足を補いながら学習している。

Microsoftは現在、デュアルアーム構成やヒューマノイドロボットなど複数のプラットフォームでRho-alphaの評価を進めており、関心のある組織向けにEarly Access Programを提供するとしている。将来的にはMicrosoft Foundry経由での利用も計画されている。

Rho-alphaは、ロボットに「感じる」能力を与えることで、従来の視覚・言語中心のAIとは異なり、物理世界の環境変化や接触フィードバックを理解し、適応的な行動を可能とすることを目指している。Microsoftはこの技術がより多様な環境でのロボット活用やHuman-Robot Collaboration(人間とロボットの協調)に寄与すると位置づけている。

AI・生成AIのおすすめコンテンツ

AI・生成AIの関連コンテンツ

PR

PR

PR