- 2026/05/07 掲載

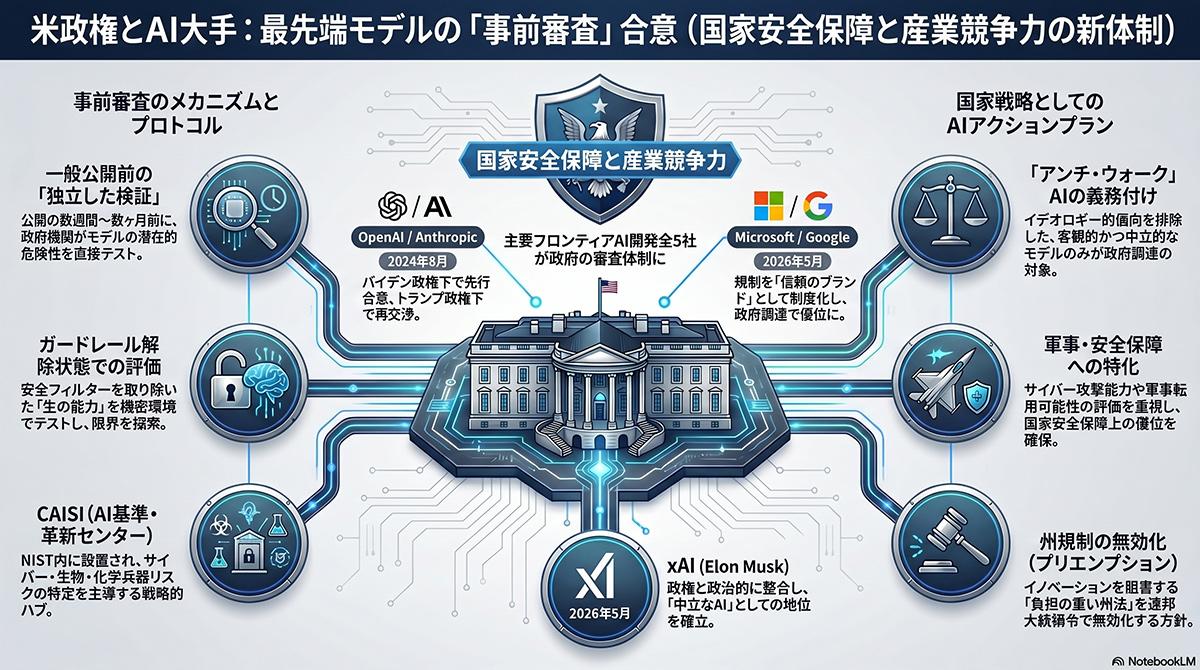

米Google、Microsoft、xAI、新AIモデルの事前審査で米政権と合意

新AIモデル一般公開前に政府へ開示、国家安全保障上のリスク審査

審査を実施するのは、商務省傘下のAI標準・イノベーションセンター(CAISI)である。開発企業はより包括的なリスク検証を可能にするため、安全対策のセーフガードを意図的に低減または削除したモデルを同センターに提供する。評価プロセスには、政府各機関の専門家で構成される「TRAINSタスクフォース」も参加し、機密環境下でのテストや継続的なフィードバックを行う。これにより、高度なAI機能がもたらす脅威をリリース前に特定し、修正を図る。事前のテストにとどまらず、デプロイ後の継続的な評価も実施される。同センターはこれまでに、未公開のフロンティアAIシステムを含む40以上の評価を完了している。

米国ではすでにOpenAIとAnthropicが同様の枠組みに参加していた。今回の3社の合意により、国内の主要な最先端AI開発企業すべてが政府の事前審査ネットワークに加わったことになる。先行して参加していたOpenAIら2社についても、現政権が推進する「アメリカのAIアクションプラン」の優先課題に適合させるべく、既存のパートナーシップ協定の再交渉が行われた。

急速な進化を遂げるAI技術に対し、米国政府は産業競争力の維持と安全保障の統合を進めている。AI技術がサイバー攻撃やインフラへの脅威として悪用されるリスクへの警戒感が高まる中、政府による独立した客観的な評価体制の構築が急務となっていた。各社が政府の事前審査に同意したことで、米国のAI開発は国家の安全保障枠組みの下で推進される体制へと移行した。

AI・生成AIのおすすめコンテンツ

AI・生成AIの関連コンテンツ

PR

PR

PR