- 会員限定

- 2023/12/28 掲載

「国産でも影響力大」、日本語特化の大規模言語モデル(LLM)が重要な理由

国際大学GLOCOM客員研究員(NTTコミュニケーションズ勤務)。現在、クラウドサービスの開発企画、マーケティング、広報・宣伝に従事。総務省 AIネットワーク社会推進会議(影響評価分科会)構成員 一般社団法人クラウド利用促進機構(CUPA) アドバイザー。著書多数。

先行する海外事業者のLLM

生成AIの進展により、LLMのパラメータ数は増加傾向にある。OpenAIが提供するLLMは、GPT-3.5のパラメータ数は1750億に対して、GPT-4のパラメータ数は公表されていないが、パラメータ数は1兆を超えるという説もある。LLMとは、文章などを作る生成AIの根本となる自然言語処理のモデルで、大量のデータを学習することで、自然な文章の作成や応答などができるようにしたAIモデルだ。

LLMでは、パラメータ数が多いほどより多くの情報を記憶し、より複雑な言語のパターンを学習する能力が高まる。同時に計算資源やメモリの要求も増加し、学習や運用の難易度も高くなる。

OpenAIなどの海外事業者は、多言語対応のLLMの開発を進め、特に英語においては記憶する情報量が多く高い性能を発揮している。その一方で、他言語、特に日本語への対応は英語と比べて情報量が少なく、十分に進んでいるとは言えない状況だ。

なぜ、国産の日本語LLMが必要なのか?

日本語の場合は、独特の文法構造と表現力を持ち、翻訳や理解が難しい言語だ。そのため、日本語の微妙なニュアンスや文化的背景を理解し、自然な言語生成を可能にするには、日本語データに特化したモデル開発が不可欠となる。また、国際競争力の観点からも、国産事業者による日本語に特化したLLMの開発や計算資源の確保、データ整備などの重要性が高まっている。

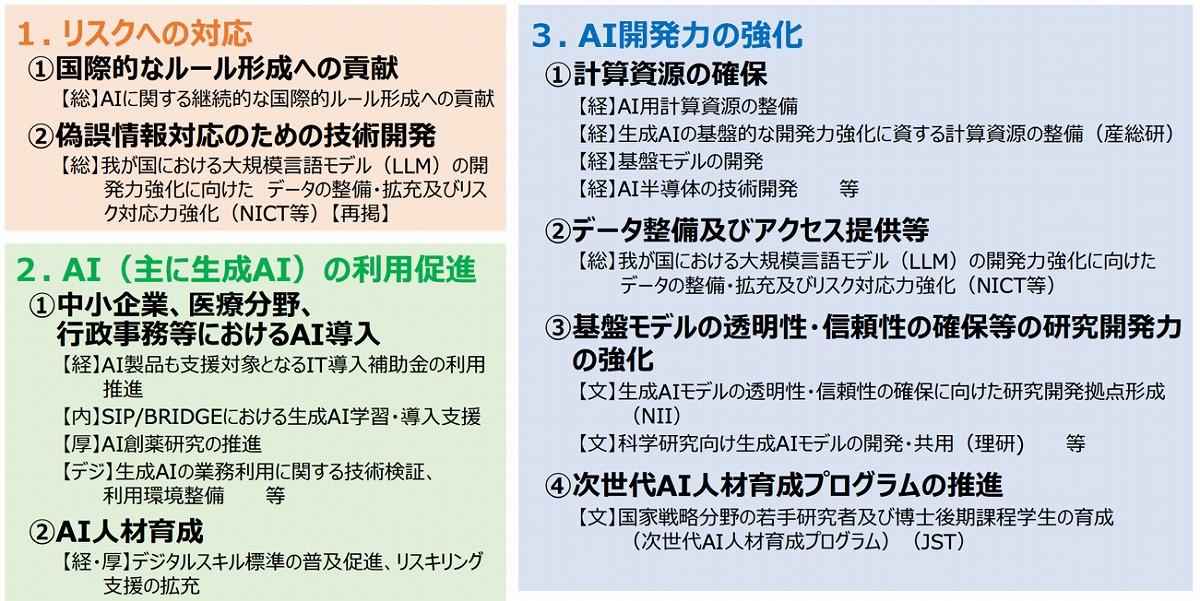

内閣府が2023年11月7日に開催した「AI戦略会議 第6回」では、日本の経済対策や国際競争力の観点から、AI開発の強化に緊急に取り組む必要があるという方針を出している。

AI開発力の強化では、以下の4施策に取り組む。

- (1)計算資源の確保(AI用計算資源の整備、基盤モデルの開発、AI半導体の技術開発など)

- (2)データ整備およびアクセス提供など(LLMの開発力強化に向けたデータ整備など)

- (3)基盤モデルの透明性・信頼性の確保などの研究開発力の強化(生成AIモデルの透明性・信頼性の確保に向けた研究開発拠点形成など)

- (4)次世代AI人災育成プログラムの推進(次世代AI人材育成プログラムなど)

政府関連の研究開発機関の取り組みでは、2023年7月に国立研究開発法人情報通信研究機構(NICT)が日本語に特化したLLMの試作を公表した。日本語のWebデータのみで学習した400億パラメータのLLMだが、すでに1790億パラメータのLLMの開発にも着手している。

また、2023年10月には国立研究開発法人 産業技術総合研究所(産総研)が東京工業大学や大学共同利用機関法人 情報・システム研究機構 国立情報学研究所(NII)などでも、1750億のパラメータ数を持つLLMの構築に着手。10月20日には、NIIがこれらの取り組みの成果として、130億パラメータのLLM「LLM-jp-13B」を公開している。 【次ページ】「国産でも影響力大」、産学の巨大プレーヤーが挑むLLM

AI・生成AIのおすすめコンテンツ

AI・生成AIの関連コンテンツ

PR

PR

PR