- 会員限定

- 2026/02/24 掲載

誤回答で訴訟に発展?ガートナー流「生成AIリスク」を回避する“4つのチェック項目”

生成AI利用「ルールあり」企業は23%

生成AIサービスの利用の伸びが著しい。ガートナーが今年3月に行った調査によれば、「ベンダーが提供する生成AIサービスを利用中」との回答は全体の63%に達している。ただし、その中で課題として指摘されるようになったのが生成AI利用のガバナンスだ。生成AIのリスクは、入力情報がAIの学習に用いられることでの情報漏洩や、生成物の著作権侵害などの例で一般に知られるようになった。

この具体例として、「海外ではハルシネーションなどを原因とするAIチャットボットの誤回答が顧客からの訴訟に発展するケースも出ています」と話すのは、ガートナー シニア ディレクター,アナリストの土屋隆一氏だ。

シニア ディレクター,アナリスト

土屋隆一氏

土屋氏によると、そうした事態の回避に向け、サービス利用に関する何らかのルール整備が不可欠だという。だが、現実に目を転じれば、「社内共通ルールや基準がある」との回答は全体のわずか23%にとどまる。生成AIサービスは事務管理や顧客対応、さらに経営戦略の立案など、基幹業務での利用が始まりつつあり、このままでは重大な事故が発生しかねない。

「生成AIサービスは多くの企業でトライアルを終え、本格利用が始まろうとしています。一方で、国内では『AI事業者ガイドライン』『行政向け生成AI調達・利活用ガイドライン』などの整備も進んでいます。それらはリスク対策の検討で大いに参考となり、判断基準が整備された今こそ対策に乗り出す絶好のタイミングと言えます」(土屋氏)

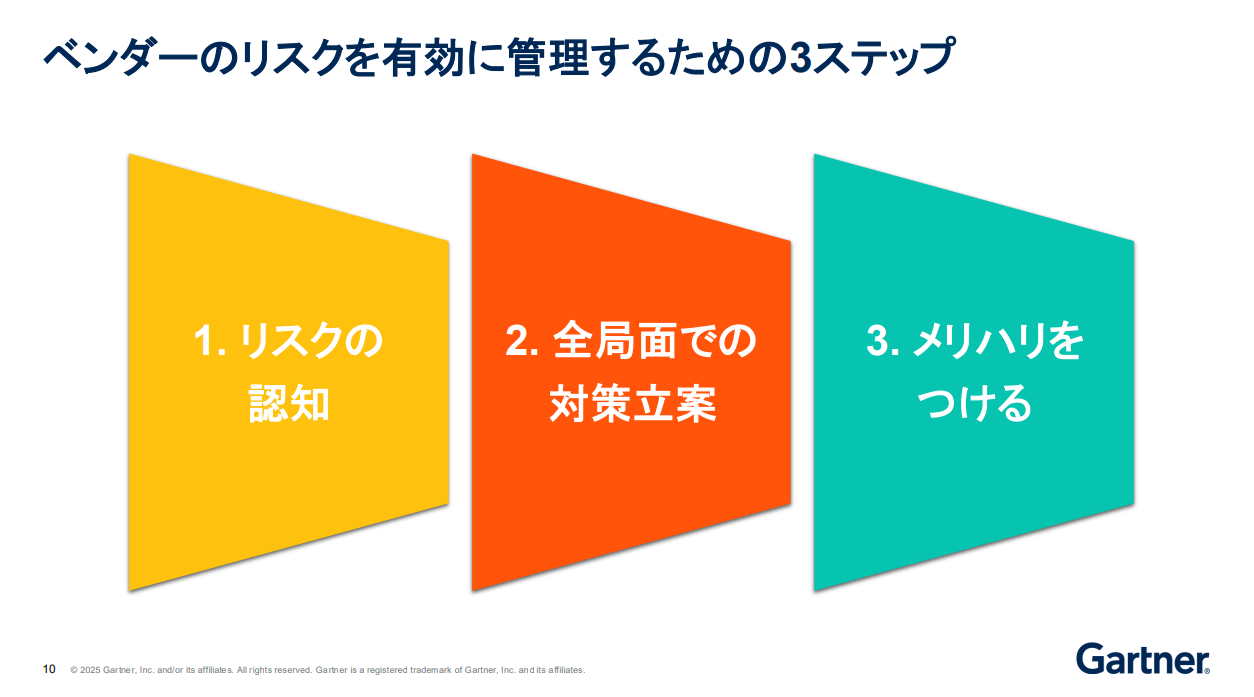

では、その対策は具体的にどんなステップで進めていけばよいのだろうか。 【次ページ】情報漏えい対策に必須「4つのステップ」

IT戦略・IT投資・DXのおすすめコンテンツ

IT戦略・IT投資・DXの関連コンテンツ

PR

PR

PR