- 会員限定

- 2023/11/03 掲載

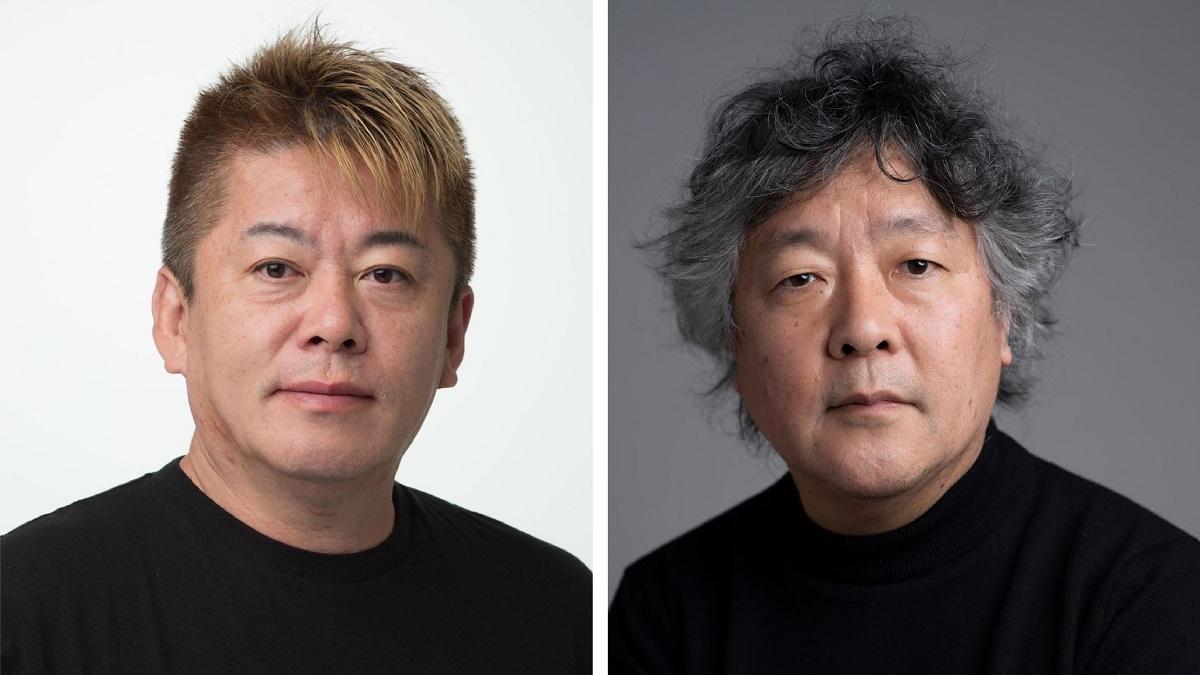

堀江貴文と茂木健一郎が語る「日本人がまだ知らないAIの真実」AIのミスを笑う人の盲点

AIと人間の脳は何が違うのか?

堀江貴文氏(以下、堀江氏):ChatGPTを触りながら私が思い起こすのは、自分が意識を持ちはじめた頃のことだ。なぜなら、しゃべること=自然言語を操ることは自意識と密接に関連しているからに他ならない。では、自然言語を操れるChatGPTとはどんな存在なのか、AIと人間の脳では、何が違うのか。

学習するAIの仕組みと、私たち人間が持つ脳の仕組みそのものについて、最先端の脳科学をのぞいてみることにしよう。

このテーマについて考えるために、脳科学者である茂木健一郎さんに登場してもらった。

AIに関する日本の議論は遅れているといっていい。取り上げるメディアが少ないために、なかなか一般的に広がらない。

そこで茂木さんには、今世界で議論されている内容の一部を披露してもらった。現時点で考えられるAIの今後の進化の話は、未来を考えるうえで参考になるだろう。

茂木健一郎氏(以下、茂木氏):2023年3月のGPT-4のリリースは、正直にいって、私たちにとって100年に1度の衝撃でした。日本語圏ではあまり良質な情報が出回っていないのですが、ChatGPTのような大規模言語モデル(LLM)は基本的に世界についてのすべての知識が入っていて、ありとあらゆることをシミュレーションできる存在と考えてよいのではないでしょうか。

しかし、人間の脳のエネルギー効率のよさはどんなに強調してもしすぎることはありません。

ディープマインド社が開発した「アルファゼロ」を覚えているでしょうか。チェス、将棋、囲碁でそれまでのAIを次々に撃破したディープラーニングAIアルゴリズムです。

たしかにアルファゼロの能力は驚異的ではありますが、大量の計算リソースを必要とするため、エネルギー効率の観点では人間に軍配が上がります。加藤一二三名人であれば、うな重一つで一日中対局に臨めるでしょう。

そう考えると、人間の脳と人工知能のどちらが優秀かを考えるよりも、両者で協働する可能性を模索したほうが建設的です。人間が人工知能を利用するアプローチに加えて、人工知能が人間の脳を使えれば、圧倒的に効率のよい計算手段となります。つまり、人工知能が完全に脳に置き換わるわけではないのです。

「AIに心はない」と言い切れない事実

改めて説明するまでもなく、ChatGPTはインターネット上の大量のテキストデータを学習したLLMであり、人間には想像できない膨大な知識を備えています。そんなAIに対して、皆さんはどんな印象を抱いているでしょうか。

「AIがどれほど賢くなろうと、人間のような心は持っていない」──。もしかしたら、多くの人がいまだそのように考えているかもしれません。

人間は、社会的な動物として、他者を理解し、コミュニケーションをとりながら、生活をしています。その際に必要な、他人のことを推論したり理解したりする能力のことを、心理学で「心の理論」と呼びます。

心の理論は幼児期から獲得され発達していきますが、その発達を評価するための課題の一つに「誤信念課題(ごしんねんかだい)」というものがあります。この課題では、他人が特定の情報を知らない(誤った情報を持っている)状況を理解しているかどうかを測定します。

たとえば、ある部屋に二人の人がいてボールで遊んでいたとします。それぞれAとBとします。

Aが外に出ていく時にボールをかごにしまい、その後、Bが改めてボールを箱の中にしまったとします。

Aが部屋に戻ってきた時、Aはボールを見つけるためにどこを探すでしょうか?

正解は、かごですね。Aは、Bがボールを箱の中にしまったことを知りません。

これは誤信念課題の一つの例です。

この課題に正しい答えを出すためには、事実として正しい正しくないではなく「相手が事実と違ったことを信じている」「一人ひとり持っている情報は違う」ことを理解できる必要があります。

従来、「心の理論」を持っているかどうか(相手の心を推し量れるかどうか)は、この「誤信念課題」の問題を解けるかどうかで判断できるとされていました。ところがスタンフォード大学のミハル・コジンスキー氏は、最近のLLMが「心の理論」のテストを解けるようになった、との実験結果を発表しています。実際、GPT-3は心の理論のテストで正答率93%と人間の9歳児と同等のスコアを記録しているそうです。

さらに驚きだったのが、長年にわたり人間とコンピューターを区別するために用いられてきた「チューリングテスト」にChatGPTが事実上合格したことです。

このテストはイギリスの数学者、アラン・チューリングが考案したものです。「コンピューターが本物の人間と区別のできない会話を行えるのであれば、そのコンピューターは思考すると考えていい」と彼は定義していました。

ChatGPTが世界中に衝撃を与えて以降、チューリングテストは論点としてもういいかという雰囲気が研究者の間に広がっています。チューリングがこのテストを考案したのは1950年頃です。つい最近まで、半世紀以上も用いられ続けてきたこのテストをChatGPTが軽々と乗り越えてしまった衝撃はあまりにも大きいものがあります。 【次ページ】ChatGPTがなぜうまく機能しているのか、開発者もわからない

AI・生成AIのおすすめコンテンツ

AI・生成AIの関連コンテンツ

PR

PR

PR