- 会員限定

- 2026/03/10 掲載

米アンソロピック、米国防総省を提訴 AI軍事利用の制限巡る対立で

OpenAIエンジニアなど40人が法廷助言書提出、AIの安全な利用求め

Anthropic が米国防総省を提訴、サプライチェーンリスクへの指定は不当と訴え

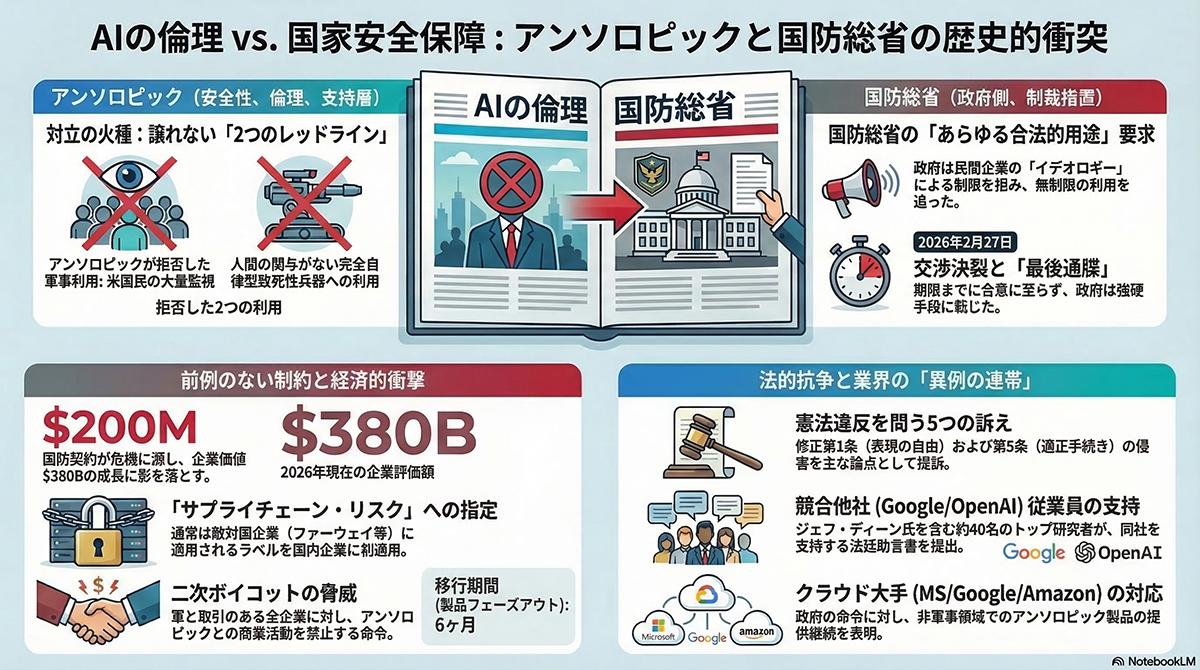

AIスタートアップの米Anthropicは、自社が米国のサプライチェーンにリスクをもたらすと米国防総省から認定された措置の取り消しを求め、サンフランシスコの連邦地裁に提訴した。国防総省はAnthropicに対し、軍がAIモデル「Claude」をあらゆる合法的用途で制限なく利用できるよう要求していた。これに対しAnthropicは、国家安全保障に関わる大半の利用に同意し軍事用途向けモデルを提供しつつも、2つの特定の用途に対する利用を明確に拒否した。

拒否した用途の1つ目は、人間の関与なしに標的を攻撃する致死的な完全自律型兵器システムへの利用である。 同社は最先端AIモデルには自律型兵器を安全に運用する信頼性がなく、ハルシネーションのリスクにより極限状況での配備は米軍兵士や民間人を危険にさらすと指摘した。2つ目は、米国市民を対象とした大規模な国内監視活動への利用であり、これは基本的人権の侵害にあたると主張している。

AIによる監視は誤謬の発生率が高く、人間のオートメーション・バイアスが加わることで被害を増幅させる危険性があると言及した。ヘグセス国防長官ら政府側は、民間企業が独自のイデオロギーで米軍の作戦に制約を課すことは容認できないと反発し、交渉は決裂した。

その結果、国防総省は通常敵対国に適用するサプライチェーン上のリスク指定をAnthropicに行った 。この決定に基づき、政府機関はAI関連業務の他社への切り替えを開始し、トランプ大統領もClaudeの使用停止を指示した。ヘグセス国防長官は軍と取引のある全企業に同社との商業活動禁止を宣言している。Anthropicは、政府が権限を行使して企業を罰することを憲法は認めておらず、今回の措置は違法であると訴状で主張している。

AIの安全利用巡る対立、OpenAIエンジニアからも法廷助言書提出、他社のスタンスは?

Anthropicと国防総省の対立は、AI業界全体を巻き込む事態に発展している。Anthropicの提訴直後、Googleのチーフサイエンティストであるジェフ・ディーン氏をはじめ、OpenAIとGoogleのトップ研究者やエンジニア約40名が、同社を支持する法廷助言書(アミカス・ブリーフ)を連邦裁判所に提出した。競合企業の研究者が連帯を示すのは異例であり、彼らは政府の不透明な基準に基づく強権的な介入がAI研究の分断を招くと指摘している。

今すぐビジネス+IT会員に

ご登録ください。

すべて無料!今日から使える、

仕事に役立つ情報満載!

-

ここでしか見られない

2万本超のオリジナル記事・動画・資料が見放題!

-

完全無料

登録料・月額料なし、完全無料で使い放題!

-

トレンドを聞いて学ぶ

年間1000本超の厳選セミナーに参加し放題!

-

興味関心のみ厳選

トピック(タグ)をフォローして自動収集!

AI・生成AIのおすすめコンテンツ

AI・生成AIの関連コンテンツ

PR

PR

PR