- 2026/03/18 掲載

OpenAI、高速・低コストに特化した軽量AIモデル「GPT-5.4 mini」および「nano」を公開

大規模モデルの強みを継承、応答速度とコスト効率に優れた軽量版

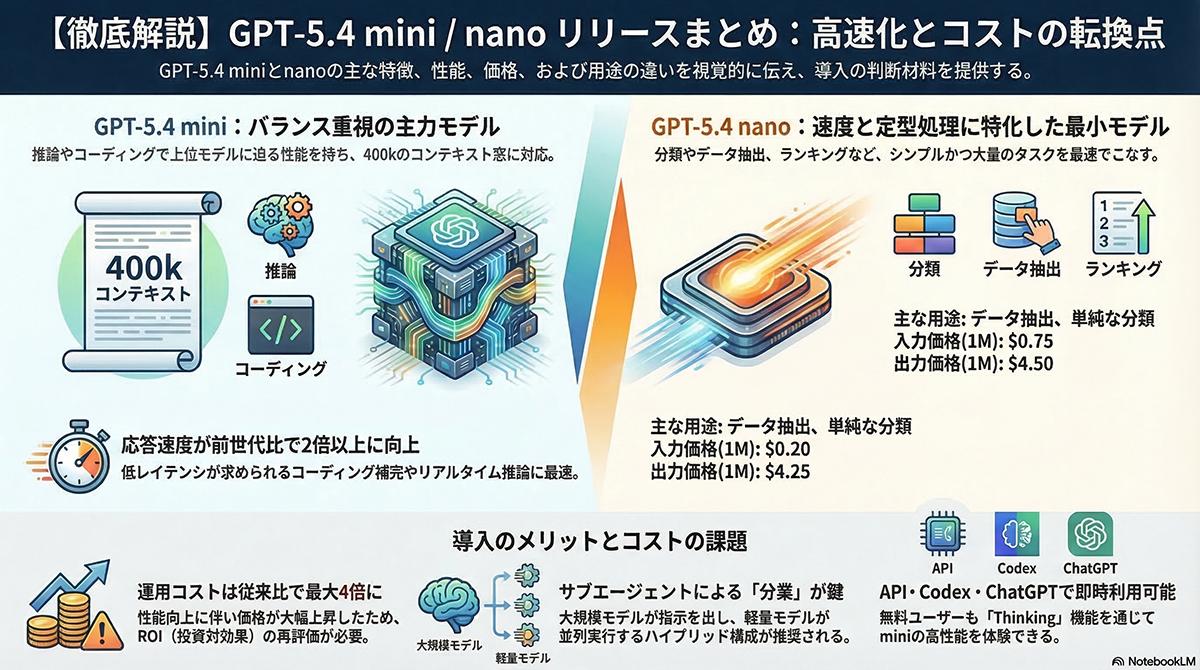

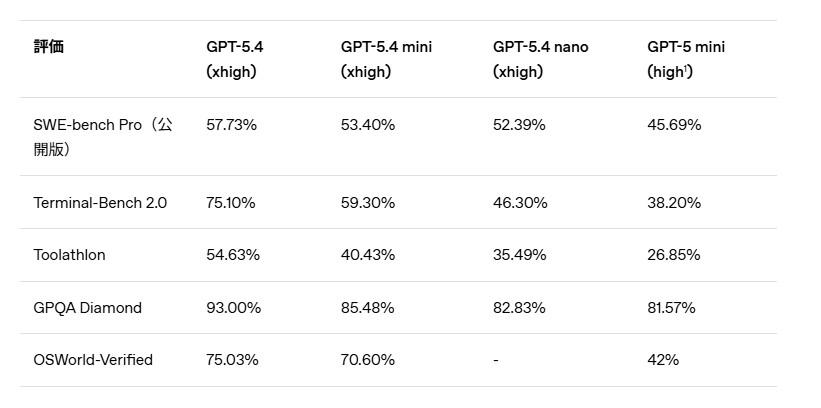

コーディング、推論、マルチモーダル理解、ツール利用の各分野で性能が改善されており、コーディング能力を測る「SWE-Bench Pro」やコンピュータ操作を評価する「OSWorld-Verified」などのベンチマークにおいて、上位モデルであるGPT-5.4に迫るスコアを記録している 。同モデルは、機敏な応答が求められるコーディングアシスタントや、メインモデルからタスクを委譲されて並行処理を行うサブエージェント、リアルタイムでのマルチモーダル推論などの用途を想定している。

一方のGPT-5.4 nanoは、シリーズ中で最小かつ最速のモデルと位置づけられている 。データ抽出、分類、ランキングといった単純な補助タスクや定型処理を処理するサブエージェントに特化しており、速度とコストを最優先する用途向けに設計された。提供状況について、GPT-5.4 miniは同日よりAPI、Codex、ChatGPTで利用可能となった。

ChatGPTにおいては、無料版およびGoプランのユーザーも入力欄のメニューから同機能を利用できる 。その他の有料プランユーザーに対しては、上位モデルが利用制限に達した際のフォールバックとして自動的に提供される。API経由での利用価格は、100万入力トークンあたり0.75ドル、100万出力トークンあたり4.50ドルに設定され、コンテキストウィンドウは40万トークンに対応する 。

GPT-5.4 nanoについてはAPI経由でのみ提供され、価格は100万入力トークンあたり0.20ドル、100万出力トークンあたり1.25ドルとなっている 。開発環境における利用では、複雑な処理の全体計画を担う大規模モデルと、並列で単純作業をこなす軽量モデルの間で役割分担させるアーキテクチャが有効とされている。

Codex環境でGPT-5.4 miniをサブエージェントとして利用した場合、上位モデルと比較してトークン消費量を約30パーセントに抑え、コスト削減と処理の高速化を両立できる。

AI・生成AIのおすすめコンテンツ

関連リンク

AI・生成AIの関連コンテンツ

PR

PR

PR