- 2026/03/21 掲載

OpenAIとAnthropic、AI兵器への悪用防止へ化学・生物兵器の専門家を採用

高度化する生成AIの危険性に対処し、内部から安全対策を講じる

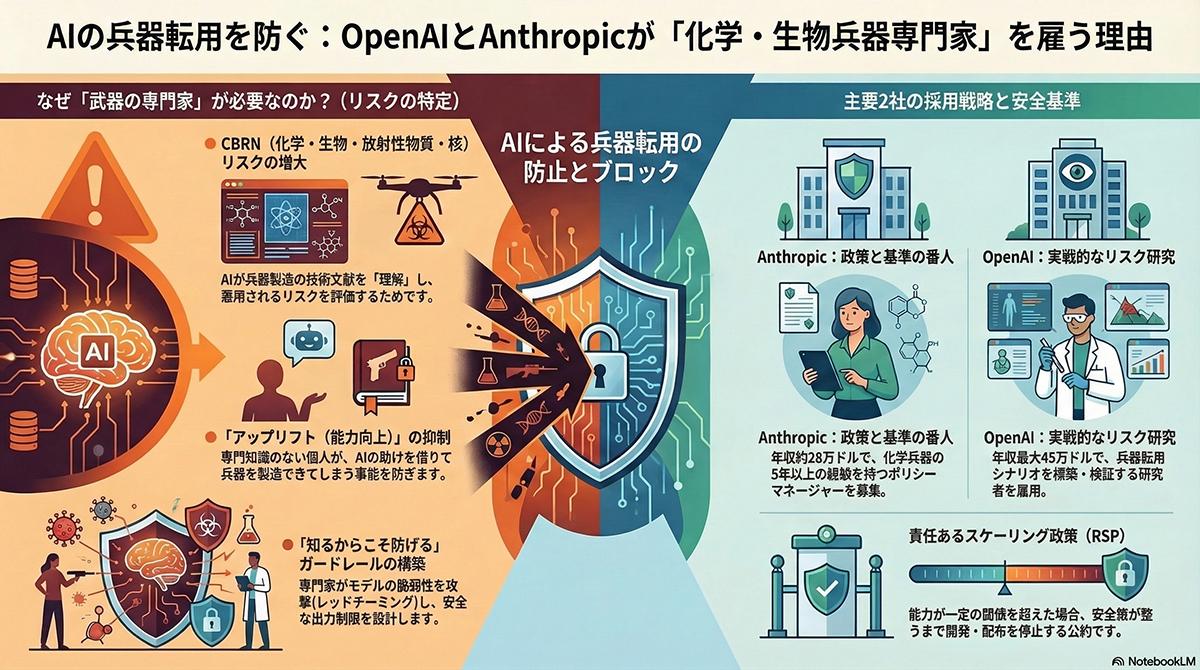

応募要件として化学兵器に関する5年以上の経験を求めており、大型爆発物防衛の経験やダーティボムに関する知識を持つ候補者を歓迎するとしている。この役職は、AIシステムのガードレール設計と政策立案を主に担い、AIの壊滅的な悪用を防ぐための重要な課題に取り組む。

一方、OpenAIはサンフランシスコを拠点とする「Preparednessチーム」において、「フロンティア生物・化学リスク研究者」の募集を行っている。提示されている年収は最大で45万5000ドルに上る。同社が求める人材は、最先端のAIモデルに関連する生物・化学分野の壊滅的なリスクを特定し、追跡し、対策を講じる能力を持つ研究エンジニアである。

具体的には、脅威モデルの構築やAIの能力評価テストの設計など、技術的な役割を担い、レッドチームとしての検証を通じてAIモデルの安全性を評価する。OpenAIはこれまでに、自社のAIモデルが初心者の科学者による生物兵器の製造を支援する目的で悪用される可能性があることを認めており、そうした事態を防ぐためのインフラストラクチャの構築を目指している。

生成AIモデルはインターネット上の膨大なデータを用いて学習しており、その中には化学兵器の合成経路や爆発物の製造方法に関する技術文献も含まれている。そのため、AIが危険な知識をユーザーに提供してしまうのを防ぐには、その知識が何を意味するかを理解している専門家が内部から評価を行わなければならないという背景がある。

両社の取り組みは、AIの能力向上に伴う化学・生物・放射性物質・核(CBRN)兵器への悪用リスクに対処し、安全性を担保するための措置の一環として位置づけられる。また、軍事や安全保障分野におけるAI利用のあり方が国際的なガバナンスの焦点となる中、自社AIの悪用を防ぐ内部体制を構築・可視化することで、規制当局や政府に対する姿勢を示す側面も帯びている。

AI・生成AIのおすすめコンテンツ

AI・生成AIの関連コンテンツ

PR

PR

PR