- 2026/04/27 掲載

Googleの「AIレッドチーム」が戦略を初公開、攻撃者観点から脆弱性を検証

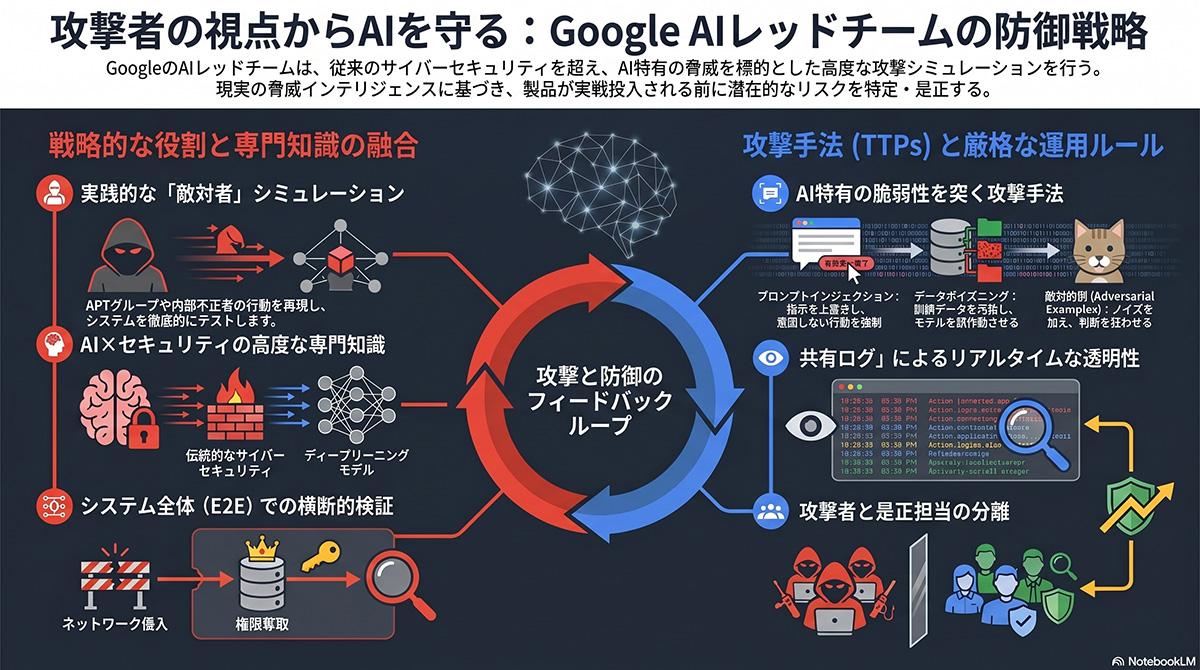

攻撃者の視点からAIモデルの脆弱性を検証、安全性を高める

AIレッドチームの主な任務は、最新のセキュリティ研究を実際の製品や機能に適用し、セキュリティ、プライバシー、不正利用の観点から潜在的な脆弱性を発見することである。具体的にシミュレーションされる攻撃手法には、システムを意図しない動作に誘導するプロンプト攻撃、モデルから機密情報を引き出す訓練データの抽出、モデルを不正に操作するバックドアの設置、AIを誤認識させる敵対的サンプル、AIの学習過程を汚染するデータポイズニング、そしてデータの持ち出しが含まれる。

AIシステムの能力向上とともに脅威の性質も常に変化しているため、Googleは現在の製品に対する脅威だけでなく、将来的に直面する可能性のある攻撃も視野に入れている。この目的を達成するため、AIレッドチームはGoogle傘下のMandiantやGoogle Threat Intelligence Groupから得られる最新の脅威インテリジェンスを活用している。さらに、Trust and Safetyチームによるコンテンツ悪用の知見や、Google DeepMindによる最先端の敵対的AI研究も統合することで、現実的かつ高度な攻撃シナリオを構築している。

Googleは、レッドチームによる演習が、あらゆる組織がAIシステムへの攻撃に備える上で決定的な役割を果たすと認識している。自社の知見やテスト手法を共有することで、広く業界全体が安全な方法でAI技術を利用できる環境の構築を目指しており、AIの安全性と信頼性を担保するための業界標準の形成を主導していく姿勢を明らかにしている。

AI・生成AIのおすすめコンテンツ

AI・生成AIの関連コンテンツ

PR

PR

PR