- 会員限定

- 2021/11/30 掲載

“力触覚”技術「リアルハプティクス」とは?手作業の遠隔化・自動化のカギを握るか

森山和道の「ロボット」基礎講座

フリーランスのサイエンスライター。1970年生。愛媛県宇和島市出身。1993年に広島大学理学部地質学科卒業。同年、NHKにディレクターとして入局。教育番組、芸能系生放送番組、ポップな科学番組等の制作に従事する。1997年8月末日退職。フリーライターになる。現在、科学技術分野全般を対象に取材執筆を行う。特に脳科学、ロボティクス、インターフェースデザイン分野。研究者インタビューを得意とする。

道具を「持ち手」と「先端」で分離する技術、リアルハプティクス

モーションリブは独自の力触覚技術「リアルハプティクス」という技術を持つスタートアップだ。「力触覚」とは力の感覚である「力覚」と、触る感覚である「触覚」をまとめた言葉である。力触覚の特徴は即時性と双方向だ。つまり、動作して対象に働きかけると時間遅れなく反作用が返ってきて、それを感じることができる。動作するたびに感覚を感じる。当たり前のように思うかもしれないが、人は随時更新されるこの感覚を利用して、さまざまな物体の硬さやたわみを感じ、対象物を壊してしまったりすることなく安全に、器用な作業を行うことがいとも簡単に行えている。そしてリアルハプティクスとは、対象の硬さや柔らかさ、変形やたわみなどを高精度に伝達できる技術である。モーションリブ取締役COOの緒方仁是氏は「道具を持ち手と先端で分離する技術」だと表現した。

たとえば、ハサミを想像してほしい。ハサミは、持ち手と、対象を切る刃の部分に分けることができる。持ち手を動かして対象を切る。両者を分離すると、いわゆる遠隔操作ということになる。モーションリブの力触覚分析や感覚再現技術を使うと、それが可能になるというわけだ。しかも同社の技術は完全に双方向だ。もちろん力触覚の再生の倍率などは任意に変えられる。つまり、リアルハプティクスを使うと、微妙な力加減が可能になる。

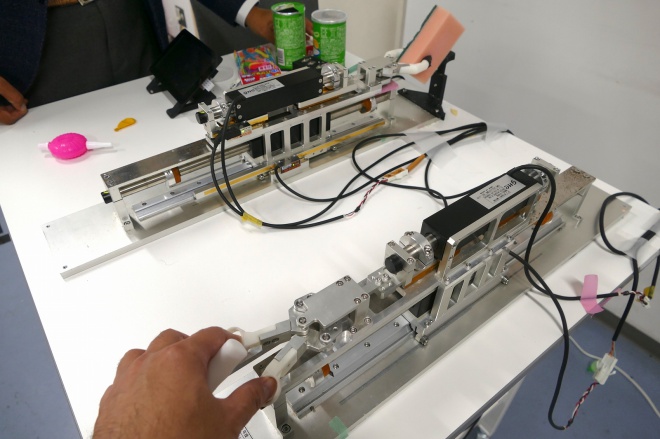

同社の技術は展示会などでも時折デモンストレーションされている。だが実際に体感しないと、その面白さや凄さはわかりにくい。いわゆるマスター/スレーブ(プライマリー/レプリカ)技術で、電気的に再生されている感覚なのだが、時間遅れが体感ではまったくないので、作用側の機械と完全につながっているように感じる。

また、機能をオンオフしてもらって初めてわかるのだが、リアルハプティクスなしでは難しい遠隔操作が容易く可能になる。たとえば、リアルハプティクス機能がオンだと、エフェクター側でポテトチップスを割らずに操作することもできる。これが、オフにするとまったくできなくなるから面白い。

いっぽう、パラメーターを変えることで逆に大きな力を出すこともできる。つまり、素手では不可能な力を出す、たとえば指では絶対に潰せないものを押しつぶすことも容易だ。しかも対象に触っている感覚を得ながら大きな力を操作することができるのである。

現状の産業用ロボットは、繰り返し動作を高速かつ高精度に実行することは得意だ。しかし、何かに触りながら、つまり力覚や触覚による微妙な情報を得ながら作業することは苦手としている。今でも、それらの多くの作業が人手で行われている。それを自動化できる技術がリアルハプティクスである。

力センサーなしで力を推定する

会社としてのモーションリブは慶應義塾大学の大西公平教授の研究成果を元に2016年4月に創業。COOの緒方氏、CTOの飯田亘氏のほか、CEOの溝口貴弘氏らもリアルハプティクスの研究メンバーだった。社員は役員を除いて現在13人。うち、3/4が技術者だ。もともとは2002年ごろに慶應義塾大学医学部からの「手術ロボットで扱う内視鏡の遠隔鉗子(かんし)のフィードバックはできないか」というニーズから生まれたものだったという。非常に細い神経や血管縫合、胎児への手術など細かい作業が必要な微細手術においてはフィードバックがないと難しいというわけだ。

ロボットの世界では、遠隔操作は放射性物質を扱うために数十年前から研究が行われている古い技術だ。だがいまだに難しい技術である。触覚はもともと作用反作用の感覚なので、リアルタイムでないと人はすぐに違和感を感じる。また、力触覚をちゃんと再現して伝送しようとすると、柔らかい制御による「力の釣り合い」だけでなく、硬い制御による「位置の追従」の両立が重要だ。両者は相反する性質を持っている。

力、位置、そして時間の3つの変数を操ることで、両者を統合制御することができるのがリアルハプティクスの売りである。エンコーダーなど位置センサーの情報から力を推定しているため力センサーレスである点も特徴だ。特殊なモーターやセンサーも必要ない。

モーションリブではそのアルゴリズムをハードウェアに実装したチップ「AbcCore」の販売、そしてサーボコントローラーとAbcCoreの組み合わせによるリアルハプティクス導入支援をビジネスとしている。なお「Abc」は「Acceleration-based Bilateral Control(加速度基準双方向制御)」の略だ。感覚自体は主観的なものなので定量化はできない。だが感覚を引き起こす刺激は定量化できる。リアルハプティクスでは、対象から感じる反作用力を自分の速度で割ったものが力触覚を表す刺激信号の物理量だと考えて定量化することで、遠隔デバイスが取得した作用力を手元デバイスで再生することができる。リアルハプティクスを使うことで、対象の質量や粘性、剛性などの情報もリアルタイムに取得することができる。

簡単にいえば、たとえばスポンジみたいなものを遠隔デバイスで押すと、その変形量に応じた剛性やバネ乗数を、手元デバイスでの感覚として得ることができる。もちろんこのデータは人が受け取るだけではなく、機械が用いるためのデータとして記録することも可能だ。より詳細に知りたい方には大西公平氏の著書『「リアル」を掴む!』(東京電機大学出版局)をおすすめする。取材に応えるかたちでわかりやすく解説されている。

力を感じることで作業自体の品質検査も可能

11月25日には三菱電機が中心となって推進している産業用ネットワークCC-Linkに対応したことがリリースされた。従来は「AbcCore」を用いようとすると通信変換処理の開発がそれぞれ必要だったが、新たに開発したシステムにより、より簡単に「AbcCore」を産業用ネットワーク CC-Link IE TSN に接続できるようになったというものだ。これによって「PLC+AbcCore+産業用機械」というかたちでシステムを組むことで、産業用機器でアクチュエータの力加減を制御し、力触覚情報を送受信できるようになった。また、PLCで一般的に使われている制御プログラムの1つであるラダー言語を用いて「AbcCore」を扱えるようになった。ラダーを使える人は製造現場に多い。よって、多くの人が「AbcCore」を使えるようになる。これによって産業用機械が人のような力加減や感触を簡単に獲得でき、作業達成状況を認識しながら動作できるようになるため、歩留まり向上への活用も期待されるという。

具体的には、どんな作業に使えるのか。「AbcCore」には制御機能とセンシング機能がある。力触覚を使うと、たとえばコネクタをはめたときの「カチッ」という感覚を使って、作業完了の確認ができるようになる。つまり、差し込みの作業と同時に、その作業自体の品質検査を行うことができるのだ。CC-Linkへの対応によって、製造現場への広がりがさらに期待される。

【次ページ】力を感じることで作業自体の品質検査も可能、大林組との共同研究も

ロボティクスのおすすめコンテンツ

PR

PR

PR