- 会員限定

- 2022/12/07 掲載

ソニーPCLが挑む「バーチャルプロダクション」、映像産業メタバース革命の正体

連載:根岸智幸のメタバースウォッチ

1963年生まれ。Webコンサルタント、プロデューサー、編集者、ライター、エンジニア。90年代のIT雑誌を皮切りにWebクチコミサイト、SNS、電子書籍出版システム、ニュースメディアのグロースなどで、時代を先取りしてきた。

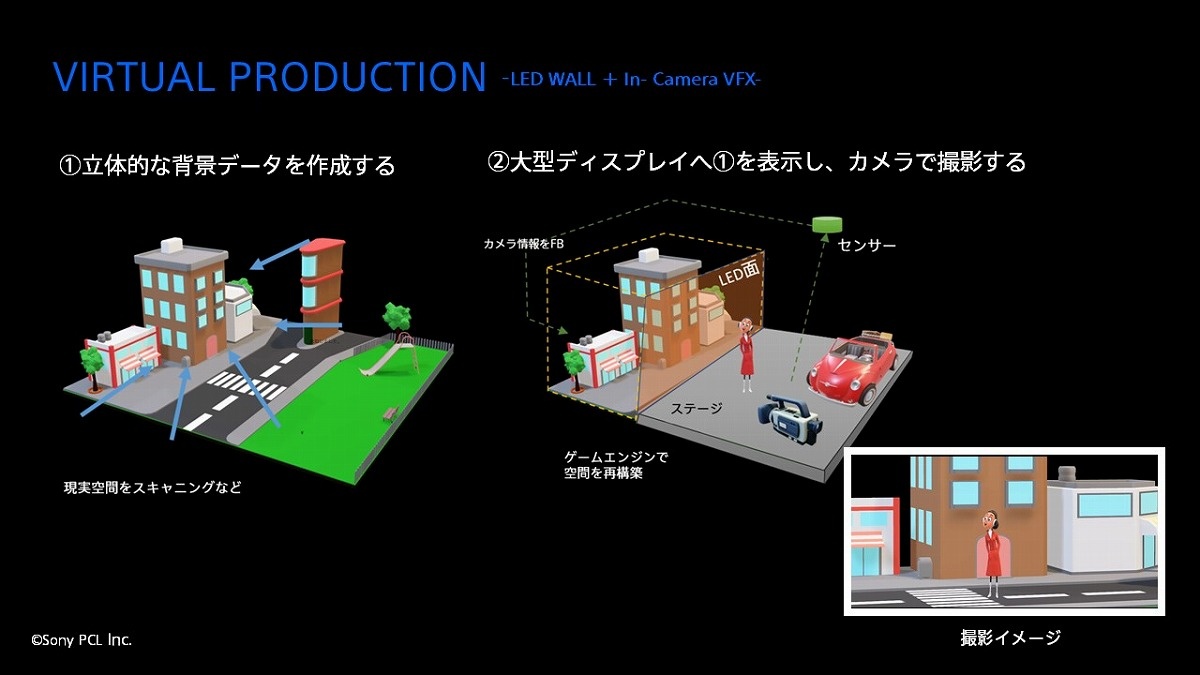

バーチャルプロダクションを実現する技術

3D CGでモデリングされた仮想空間の中で、人やモノ(クルマなど)がそこに入り込んだかのように撮影する手法を「バーチャルプロダクション」と呼ぶ(注)。この技法は主に以下の技術によって成立する。

- 巨大LEDウォール

- カメラトラッカー

- Unreal Engine

巨大LEDウォールには、ソニーの「Crystal LED B」シリーズのように人間の目で判別が難しいほど高詳細なLEDウォールを使用して3D CGで作った背景を投影する。

カメラトラッカーは、シネマカメラの位置、角度、レンズの焦点や歪みの情報など、背景を生成するPCに送出する機器だ。

そしてUnreal Engineが、カメラトラッカーの情報を元に背景CGをリアルタイムにレンダリングしながらLEDウォールに映し出す違和感のない映像を生成する。人物やカメラが移動すればそれに合わせて背景のCGも動く。それを撮影することで、まるで人物がCG背景のロケーションにいるかのような映像となる。

これらを実現するバーチャルプロダクション手法を「インカメラVFX」と呼ぶ。

インカメラVFX的な技術は以前から存在していた。それが巨大で高詳細なLEDウォールが利用可能になったことや、高性能GPUの普及、Unreal Engineなど高性能なゲームエンジンが手軽に使えるようになったことで現実的な手法になった。2019年からDisney+で配信されたスター・ウォーズのドラマシリーズ『マンダロリアン』での使用をきっかけに広がり、全世界で200を越えるバーチャルプロダクション対応スタジオが設立されたという(CGWORLD調べ)。

バーチャルプロダクションが注目される理由

ソニーPCLは2020年8月からバーチャルプロダクションのテストを始め、本社内に作った5K LEDウォールの実験スタジオを手始めに、東宝スタジオ内に研究開発・事業拠点を移し、さまざまなサイズや形状のLEDタイプでPoB(ビジネス実証)を実施した上で、自社の「清澄白河BASE」内に8Kサイズ(9600 x 3456px)のLEDを備えた大型バーチャルプロダクションスタジオを2022年2月に開設した。同社のビジュアルソリューションビジネス部 統括部長 小林大輔氏によると、案件ベースでは床や左右の壁もLEDにすることを試したが、現在は一枚の湾曲した壁面型LEDで撮影している。床にLEDを敷くと、リアリティある光表現が難しいためCMやドラマ用途では使用していない。天井は車体の反射などを作る環境光のためにLEDを常設している。

小林氏はバーチャルプロダクションによって「さまざまな制約により不可能だった映像表現を叶えることができる」と言う。

ロケ撮影にはさまざまな不確定要素が伴う。スタッフやキャストのスケジュールを調整して臨んでも、交通渋滞、天候や季節の問題、演者の拘束時間の問題などがクリエイティビティとは別の点が不確定要素となる。

スタジオ撮影の場合は、背景セットの制作に多大なコストがかかるし、どんなに精巧なセットも撮影が終わったらバラさなければならない。すべてを保存するのも難しいから使い回しも簡単ではない。

あとからCGと合成するグリーンバック撮影では、俳優もスタッフも何もない緑の空間の中で完成時の絵面を想像しながら作らねばならない。

バーチャルプロダクションなら天候も季節も大きな障害にならない。演者の拘束時間も短縮できる。CGの背景セットや小道具、大道具は保存の問題はないし使い回しもしやすい。LEDウォールに背景画を投影しながら撮影するから完成イメージが想像しやすい。

バーチャルプロダクションは万能ではないが、既存の撮影手法と組み合わせて使うことで、コストの軽減やスケジュールの短縮を実現できるのだ。

【次ページ】バーチャルプロダクションの実例

メタバース・VR・AR・MR・SR・xRのおすすめコンテンツ

PR

PR

PR