- 会員限定

- 2024/05/28 掲載

アクセンチュア流やらないとマズい「生成AIリスク管理」、3つのワナを回避せよ

連載:アクセンチュア流「生成AI時代の仕事術」

鈴木 博和(すずき・ひろかず)

アクセンチュア ビジネス コンサルティング本部 Data&AIグループ AIセンター アソシエイト・ディレクター 。

東京工業大学大学院情報理工学研究科計算工学修士課程、東京理科大学大学院イノベーション研究科技術経営修士課程修了。事業会社にて十数年におよびAIの研究開発・マネジメントおよびエネルギー・デバイス・メディカルなどの多領域での研究企画に従事。その後、IT系コンサル会社にて主に情報通信・流通・メディカル業界のクライアントに対し自然言語処理を中心としたソリューションのPoC~導入・運用支援を多数経験。現在はアクセンチュアにて、AI POWEREDサービスの一つ、AI POWEREDバックオフィスの開発・提案・デリバリーのリードやResponsible AIの日本リードを担当。著書に「責任あるAI『AI倫理』戦略ハンドブック」、『生成AI時代の「超」仕事術大全』。

生成AIのリスクは開発者が想定していない形で現れる

2024年2月、グーグル(Google)は同社の生成AIサービス「Gemini(旧Bard)」が「歴史的な画像の描写が不正確」という指摘を受け、サービスを一時停止し調整する方針を発表した。「1943年のドイツ兵を描いて」という指示文(プロンプト)で、黒人やアジア人の画像を生成したことなどが問題視されている。一般的に、画像生成AIの生成結果は学習データのバイアスを反映し、偏った生成結果をアウトプットしてしまうことがたびたび指摘されている。たとえば「CEOを描いて」というプロンプトに対して白人男性が生成されやすいといったこともそうだ。

これには多様性を考慮した画像生成になるように調整するという手法がとられるが、今回のGeminiの例はこれが裏目に出た形となった。Geminiが多様な人物を生成するように調整されたことにより、逆に多様な人物を「表示すべきでない」場合が考慮から漏れていたことが原因と見られている。

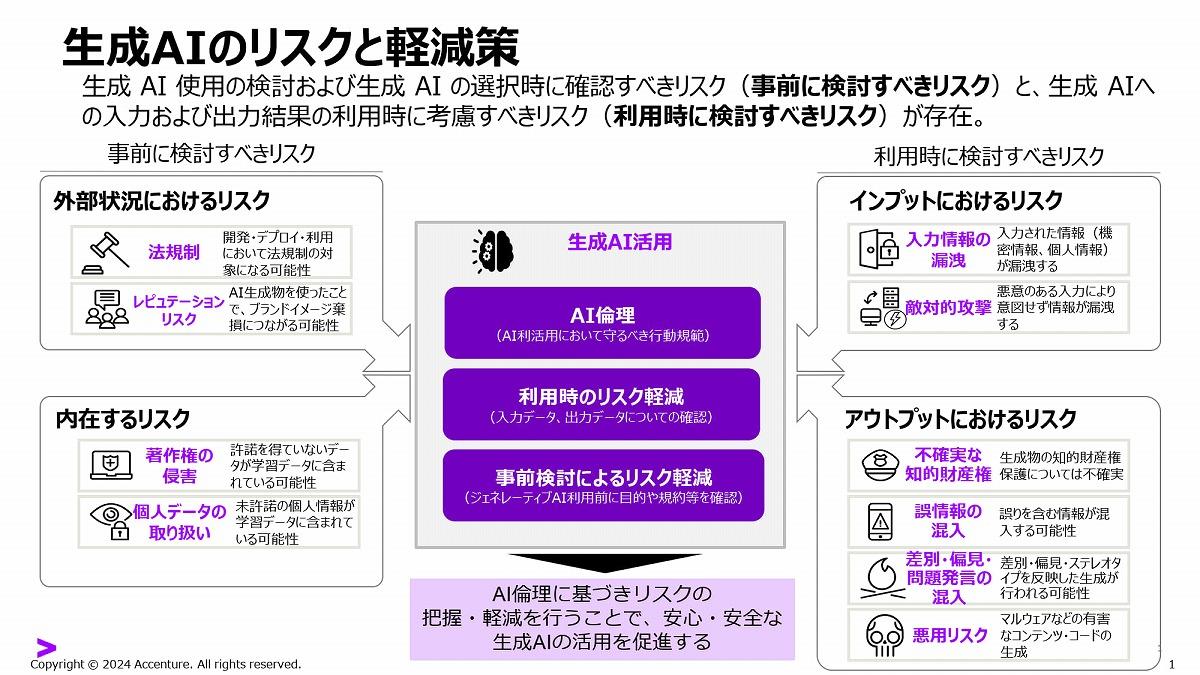

この事例は図の生成AIの「アウトプットにおけるリスク」のうち「誤情報の混入」に相当するリスクだ。生成AIのリスクは開発者が想定していないような形で現れることが多く、サービスを提供する企業はもちろんのこと、そのサービスを利用する企業も対策を行わなければならない。

欧州連合(EU)ではAIに対する包括規制の制定が進められており、2024年3月13日には欧州議会にて最終案が賛成多数で可決、5月21日には閣僚理事会が承認し正式に成立している。本規制案はAIのリスクを4つに分類し、それぞれのリスクに応じた措置を事業者に義務付けるものだ。違反をすると最大3,500万ユーロ(もしくは世界売上高7%)の制裁金が科されるという厳しいものだ。

生成AIについては、AIモデルを提供する事業者に対し、学習の際に用いた著作物の情報開示や品質管理などが求められており、川下のサービス提供者がEUでの義務を遵守できるよう、詳細な技術文書やわかりやすい使用説明書を作成することが義務付けられている。

したがって生成AIを利用したサービス提供者はこれらの情報に基づき適切な対応が求められることになる。AI規制の施行に向けて前進している欧州の動向は、今後のAI関連ビジネスの動向を予測していく上でも注目されている。

AI・生成AIのおすすめコンテンツ

AI・生成AIの関連コンテンツ

PR

PR

PR