- 会員限定

- 2023/09/06 掲載

量子機械学習とは何か?「量子技術」と「AI技術」の可能性をグッと広げる理由とは

合同会社Noteip代表。ライター。米国の大学でコンピューターサイエンスを専攻し、卒業後は国内の一部上場企業でIT関連製品の企画・マーケティングなどに従事。退職後はライターとして書籍や記事の執筆、WEBコンテンツの制作に関わっている。人工知能の他に科学・IT・軍事・医療関連のトピックを扱っており、研究機関・大学における研究支援活動も行っている。著書『近未来のコア・テクノロジー(翔泳社)』『図解これだけは知っておきたいAIビジネス入門(成美堂)』、執筆協力『マンガでわかる人工知能(池田書店)』など。

量子機械学習とは?理解が深まる関連用語も解説

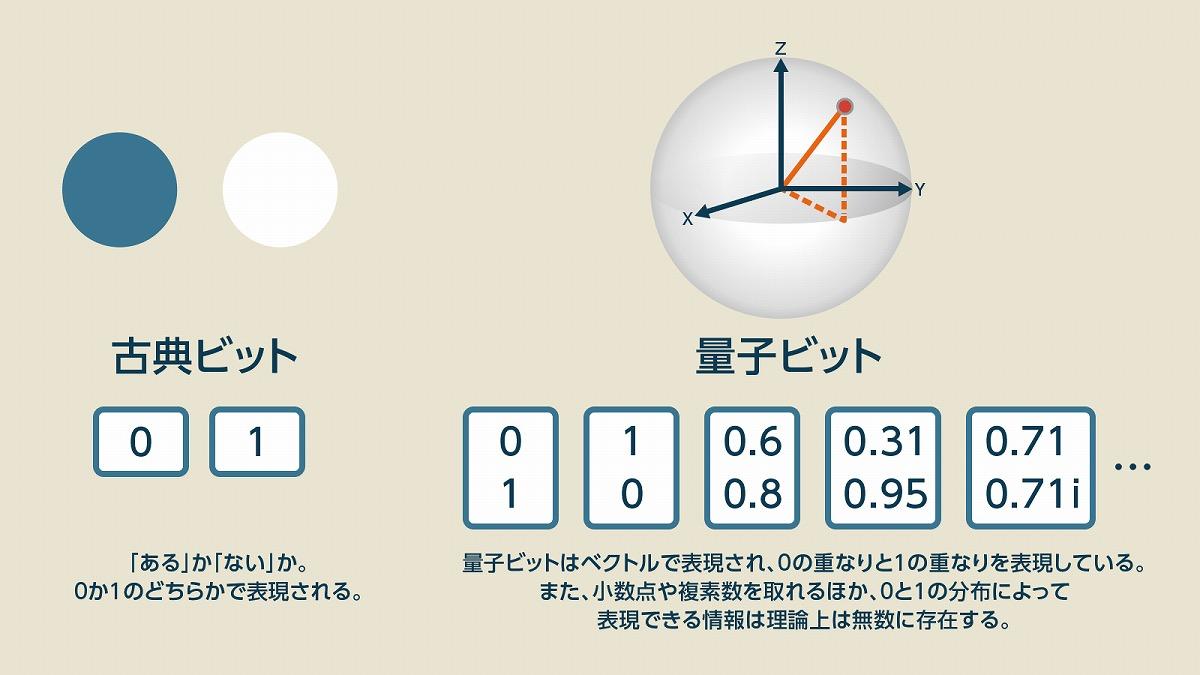

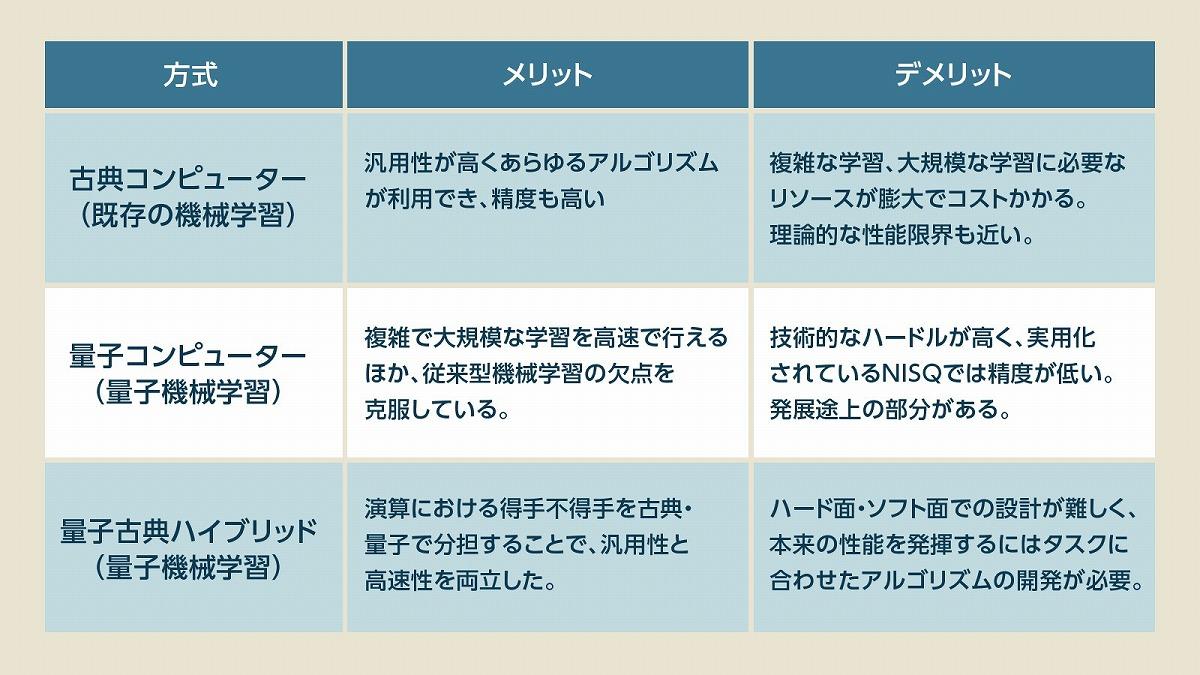

量子機械学習(QML: Quantum Machine Learning)とは、量子コンピューティングと機械学習を組み合わせた技術です。量子機械学習の話を詳しくする前に、まずは基本的な前提条件を確認しておきましょう。私たちが使っている従来方式のコンピューターである「古典コンピューター」と量子技術を用いる「量子コンピューター」の最も大きな違いは、演算に用いる情報の扱い方にあります。古典コンピューターにおける最小単位は「0」もしくは「1」で構成される古典ビット(Bit)で、量子コンピューターにおける情報の最小単位は「0」と「1」を同時に合わせ持つ量子ビット(Qubit)です。

ただ、量子ビットと一口に言っても色々な種類があり、その方式によって「0と1の重ね合わせ」をどのように実現するかが異なるほか、計算に用いる理論や装置も異なります。実際に量子ビットという名前がついている方式だけでも「超伝導量子ビット」「光量子ビット」「トポロジカル量子ビット」などがあり、それぞれ異なる量子現象を利用し、異なる量子ビットの性質を持っています。

この量子ビットの性質そのものが「量子コンピューターの方式」になります。そして、場合によっては、量子機械学習の実現方法もこの方式に応じて変わってきます。ある量子ビットなら実現できる機械学習が、ほかの量子ビットではできないということもあり得るのです。

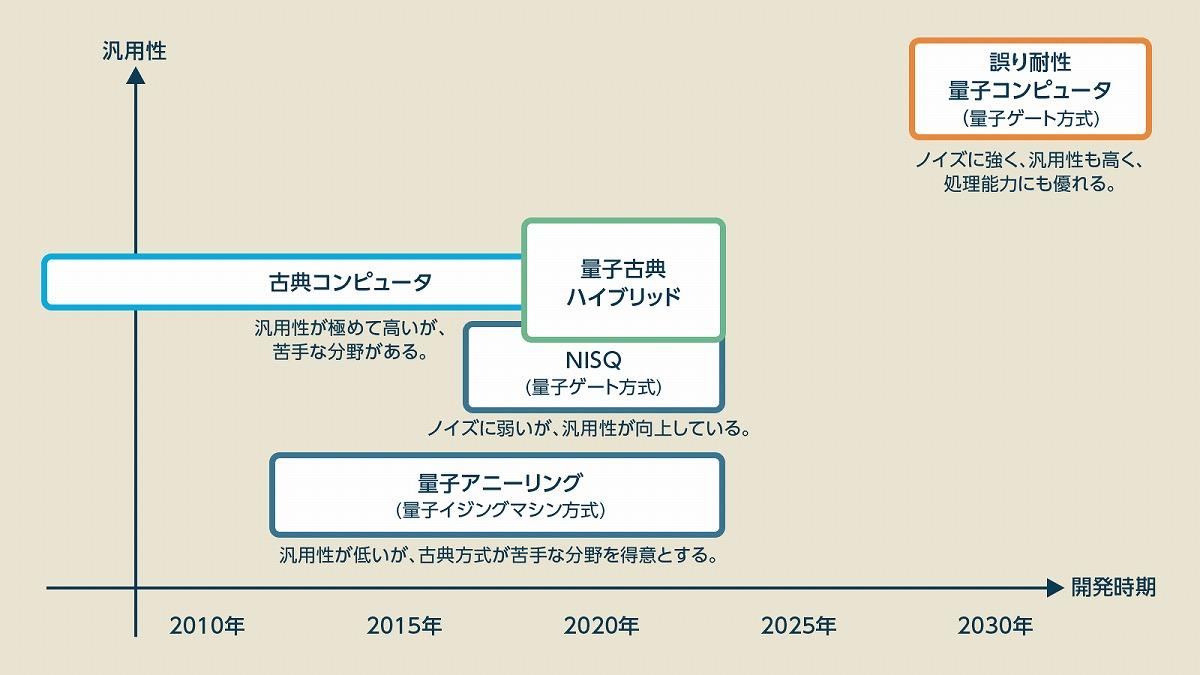

たとえば、「量子イジングマシン(アニーリング)」と呼ばれる方式では、量子空間に現実世界の擬似的なモデルを作り出し、その中で起こる量子現象で演算を行います。このような方式は特定のタスクに特化している一方で汎用性が低い特性を持ちますが、一度に数百・数千という膨大な数の量子ビットで演算が行えるため、適したタスクでは圧倒的な性能を示します。また、一部の機械学習のアルゴリズムを応用することで量子機械学習を行うことも可能です。

ただ、このような擬似的な量子モデルを演算装置として利用する量子コンピューターは汎用性が低いことから古典コンピューターを代替するものにはなりません。古典コンピューターを代替する可能性があるとして注目されているのは、より汎用性が高い「量子ゲート(回路)方式」の量子コンピューターです。

量子ゲート方式は、汎用性の高い古典コンピューターの情報処理を量子ビットに置き換えたような数学理論で構成されており、理論上は既存の機械学習アルゴリズムを流用できます。ただ、量子ビットは古典ビットとは性質が大きく異なるのでそのままでは使えず、従来のアルゴリズムの量子版がそれぞれ新たに開発されています。

これらは「量子アルゴリズム」と呼ばれ、量子的な演算を前提に設計し直されています。すべての古典的なアルゴリズムに量子版があるわけではありませんが、量子コンピューターの実用化に伴って研究が盛んになっている分野で、量子版しか存在しない新しいアルゴリズムや量子アルゴリズムから着想を得た新しい古典アルゴリズムなどが登場しています。

量子機械学習が注目される理由、重要用語「NISQ」とは

量子機械学習(QML)が注目されている理由は「機械学習を使った人工知能(AI)研究が進歩しているから」だけではありません。実は、量子ゲート方式の特有の現象が関係しています。それは「量子ビットが不安定でノイズに弱い」かつ「0と1の重ね合わせ状態は観測すると変化する」という性質です。ノイズによって計算中にエラーが発生しやすくなっている上に、エラーを検知すること(誤り訂正)が極めて難しいのです。検算のために量子ビットをコピーしようとしても、コピーするための観測で量子ビットが変動する(量子複製不可能定理)ので、エラーチェックによってエラーが起きるというわけです。この問題は複雑で長大な計算を行う場合に顕著になり、大規模な量子コンピューターを作れない原因になっています。

しかし、このような直接的な検算や複製を利用して誤り訂正を行う手法は古典コンピューター時代の考え方で、量子コンピューターならではの誤り訂正手法も開発されています。それが「量子誤り訂正(QEC; Quantum Error Correction)」と呼ばれる技術です。

さまざまな手法が検討されていますが、その多くが誤り訂正用の「符号」として用いる量子ビットを別途用意するというものです。このような量子誤り訂正の技術により、量子誤り耐性を獲得した量子コンピューターが古典コンピューターを代替する「究極の量子コンピューター」と考えられています。ただ、この技術はまだまだ実験段階であり、実証はされているものの実用レベルのものはありません。

では、今までに実用化されている量子コンピューターは何なのかという話になりますが、実は現在使われている量子コンピューターはすべて「誤り訂正が不要」もしくは「誤りを許容した」量子コンピューターとなります。たとえば、量子アニーリングなどは数千量子ビットという膨大な情報を一度の演算で処理してしまうので、多少のエラーが発生しても問題はありません。

一方、量子ゲート方式の量子コンピューターでは、配置されている量子回路ごとに細かく演算を行うことからノイズの影響が大きくなり、複雑で長大な計算には適しません。それでも規模を小さくし、ノイズを減らし、扱える量子ビットも数十から数百の量子ビットに抑えることで実現は可能です。このようなノイズの影響を許容した小規模な量子コンピューターを「NISQ(Noisy Intermediate-Scale Quantum)」コンピューターと呼びます。

量子機械学習は、このNISQで特に注目されるようになりました。というのも、量子機械学習では多少のノイズや誤りは誤差の範囲であるほか、さらにノイズによる量子ビットの変動が機械学習アルゴリズムによっては良い影響を与えることもあるからです。

NISQおける量子機械学習と量子古典ハイブリッド

NISQでは、ノイズの影響をゼロに抑えることはできません。そのため、現状は多少のエラーが出たとしても問題ないような用途や手法が使われており、量子機械学習もその1つと考えることができるでしょう。機械学習のアルゴリズムは統計理論がベースになっており、収集された膨大なデータによって認識や生成に用いられる学習モデルが構築されます。多くの場合、この収集データ自体に多かれ少なかれノイズが含まれているため、機械学習のアルゴリズムはノイズが含まれることを前提に設計されるのが一般的です。正確な計算が必要なものではなく、精度が100%でなくとも利用できます。この点で、量子機械学習はNISQでも使いやすくなっています。

一方、機械学習で最も恐れられている現象の1つが「過学習」と呼ばれる現象です。これは偏ったデータや逆に綺麗なデータで学びすぎた結果、学習モデルがデータに対して過敏に反応するようになり、却って精度が落ちる現象です。人間で例えるなら、同じような仕事に慣れてきたことで、いつものパターンに当てはめようとして柔軟性を失ってしまうようなイメージが近いかもしれません。

これを避けるためにデータにあえて「ノイズ」を混ぜるような手法が用いられますが、最初からノイズの多いNISQでは古典コンピューターに比べて、比較的過学習が起こりにくいとされています。

また、後述する量子回路学習(QCL)では、ニューラルネットワークと同じような仕組みで学習を行いながらも回路特性の違いから古典コンピューターに比べて過学習が起こりにくい特性を持ち、さらに特徴量の表現能力が古典コンピューターよりも優れているため、小さな回路で高い性能を発揮します。

ただ、このようにノイズの影響が少なかったとしても、ノイズというのは基本的には邪魔な存在です。どんなに工夫をしても、ノイズでエラーが出る前提でできることは限られます。そこで汎用性を高めるために、ノイズを入れたくない計算には古典コンピューターを用いる「量子古典ハイブリッド」のNISQコンピューターが開発されました。

ノイズに強いだけではなく、この方式では古典データと量子データをそのまま同時に扱える点が大きなメリットになっており、分子構造のような量子世界の「複雑な情報」を量子ビットでダイレクトに表現しつつ、厳密で「複雑な計算」が必要な作業は古典ビットを使うような形で計算をするのです。

アルゴリズムをハイブリッドモデルに合わせて最適化することで、量子古典ハイブリッド型のスーパーコンピューターで利用可能な量子アルゴリズムが増えました。これにより、量子機械学習が理論だけのものではなくなったのです。

今まで量子コンピューターは理論研究だけは進んでいたものの技術が追いついていませんでしたが、それが近年の技術革新によって「実践できる理論」が増えたことにより、従来の理論を発展させる形での研究が活発になっています。

量子機械学習アルゴリズムの事例

量子機械学習自体まだまだ研究中であり、実用レベルではありません。また、いくつかの理論は実機で実証されていますが、すべての量子機械学習アルゴリズムがNISQで実装できるとは限りません。それでもさまざまなアルゴリズムがテストされていますので、何点か軽く紹介していきます。また、量子機械学習でも古典機械学習と同様に、データの扱い方によって「教師あり」「教師なし」「強化学習」のような分類が可能です。ここからは、分類ごとに事例を紹介していきます。

事例(1):量子回路学習(教師あり学習)

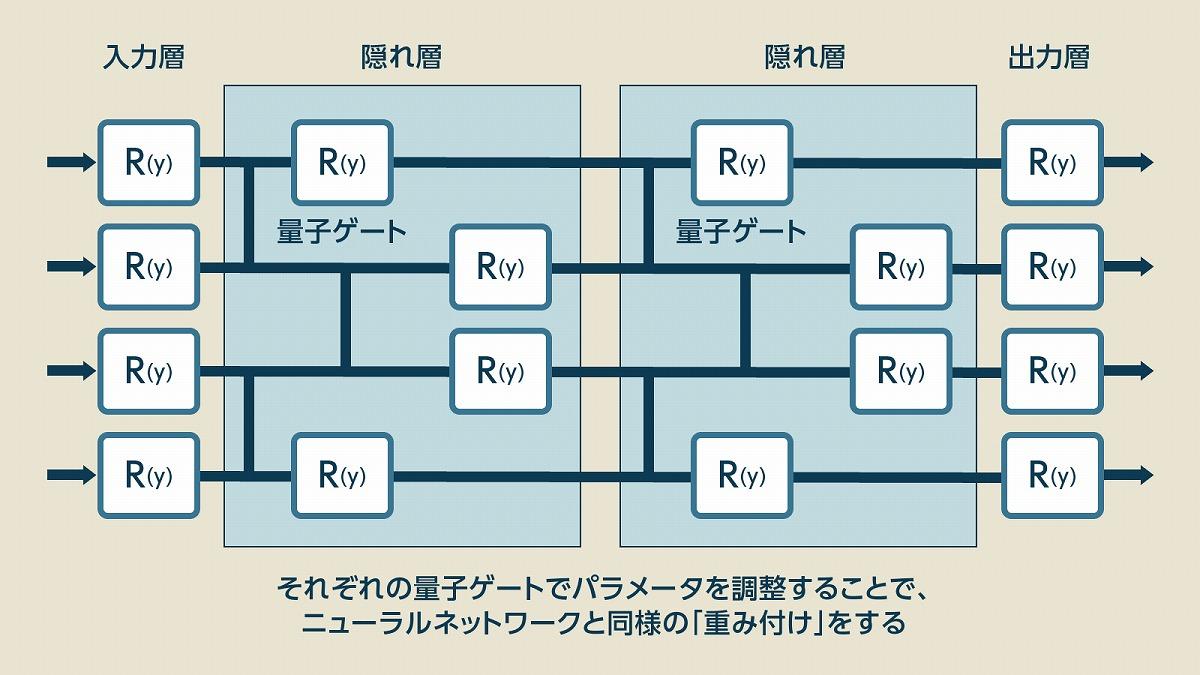

量子回路学習(Quantum Circuit Learning)は、回路を並列に配置し、量子ゲートのパラメータを変えることでニューラルネットワークに比べて単純な構造でありながら、より複雑な「重み付け」を可能にした機械学習です。量子ビットは古典ビットに比べて情報量が多いため、1つのネットワークで多くの情報を表現できます。これによりディーラーニングで課題となっていた巨大なネットワーク構造を小規模化することが可能になるほか、量子ビットの性質と制約から過大なパラメータになりにくく、過学習が起こりにくい性質を手に入れました。

事例(2):量子ニューラルネットワーク(教師あり学習)

量子ニューラルネットワーク(QNN: Quantum Neural Network)は、文脈によって意味が異なります。上述のQCLやその発展形を指すこともあれば、量子ニューロンを利用したネットワークで「ニューラルネットワーク」を再現したイジングマシン方式の量子コンピューターを指すこともあります。一般的には前者の意味で使われ、量子パーセプトロンなどの様々なパターンのQCLアルゴリズムが開発されたほか、ハイブリッド型のNISQなどではQNNが実際に使われています。現在のディープニューラルネットワーク(DNN)に比べると、NISQのQNNは層が薄くシンプルですが、初期の同規模の古典ニューラルネットワークと比較すると、非常に複雑なタスクが実行できます。 【次ページ】量子機械学習アルゴリズムの事例、残り3選を解説

量子コンピューターのおすすめコンテンツ

量子コンピューターの関連コンテンツ

PR

PR

PR