- 会員限定

- 2023/02/09 掲載

人間中心のAI(HCAI)とは? 内閣府が提唱する「7つの社会原則」もわかりやすく解説

合同会社Noteip代表。ライター。米国の大学でコンピューターサイエンスを専攻し、卒業後は国内の一部上場企業でIT関連製品の企画・マーケティングなどに従事。退職後はライターとして書籍や記事の執筆、WEBコンテンツの制作に関わっている。人工知能の他に科学・IT・軍事・医療関連のトピックを扱っており、研究機関・大学における研究支援活動も行っている。著書『近未来のコア・テクノロジー(翔泳社)』『図解これだけは知っておきたいAIビジネス入門(成美堂)』、執筆協力『マンガでわかる人工知能(池田書店)』など。

人間中心のAIとは?

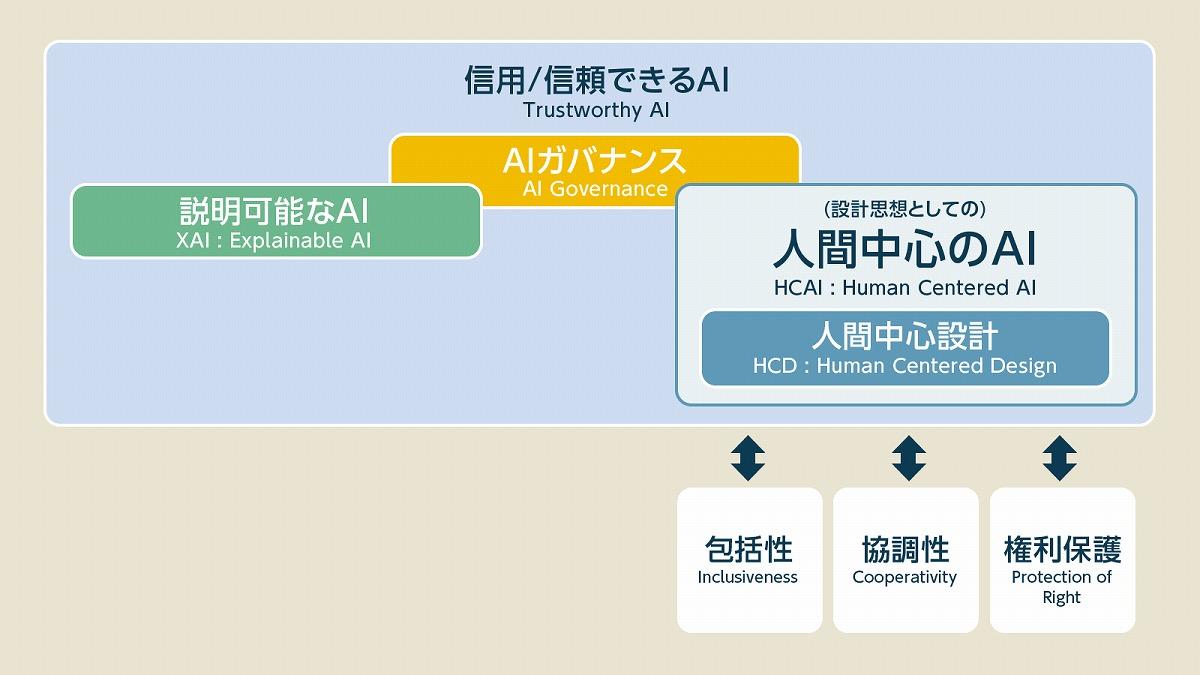

人間中心のAI(HCAI: Human-Centered AI)とは、「AIに人間が使われるのではなく、人間がAIを使う」という考え方の下、人間の管理下で、人間の能力を拡張させる手段としてAIを活用しようとする考え方を指します。この人間中心のAIという考え方に対して、人間の能力を完全にAIに置き換える「自律型AI」という考え方もあります。人間中心のAIという言葉は、細かく言えば、マクロな視点とミクロな視点、大きく2つの意味で使われます。

マクロな意味では、冒頭で述べたように、AIを「人間と協調し、人間の活動を支援し、人間の能力を拡張するため技術」として人間中心のAIという言葉を使います。このアプローチにおいてポイントになるのが、「AIが完全に人間の手を離れて運用されることはない」という点です。

この場合、AIを扱うための「理念」や「管理手法」としての文脈で人間中心のAIという言葉が使われるため、人間によってAIを管理するシステムが機能していれば、人間から完全に独立して動作することが可能な自律型AIを利用する形であっても人間中心のAIと捉えることができます。つまり、この場合の「人間中心のAI」は人間とAIの間に「明確な主従を置く考え方」と理解することができます。

一方、ミクロな意味で使われる場合、この言葉はAIの特性や様式を指して「ユーザーの意図を汲み、配慮し、協力して動作するAI」のことを指します。この場合、ユーザーに使いやすいような設計を考える「人間中心設計(HCD: Human-Centered Design)」などが最大限考慮され、混用されている場合もあります。

このような設計思想として人間中心のAIという言葉が使われるケースでは、ユーザーと協調しない自律型AIとは相反する設計思想となるでしょう。記事冒頭の図に当てはめる形で比較すると、下記のように整理することができます。

ただ、近年における関心の高まりから人間中心のAIはAIに関する代表的な社会理念として、マクロ的な意味で使われることが多くなっています。

さらに、人間中心のAIという理念を実践するために、組織や社会が守るべきルールとして「AI倫理」が定められるようになると、AIを管理する方法論となる「責任あるAI」などが登場し、日本では人間中心のAIを社会的に実装するための原則として「人間中心のAI社会原則」などが内閣府で考案されるようになりました。

人間社会の中で、AIを人間に利益をもたらすものと捉えた上で、それをより安全に正しく運用するための基本的な理念として「人間中心のAI」が掲げられるようになったということです。

人間中心のAIが注目される理由

このような形で人間中心のAIという言葉が、理念や原則に近い使われ方をするようになるにつれて、その言葉の意味自体は漠然としたものになっています。人間中心のAIが、ある種の「人間とAIの理想の関係性を表す言葉」として使われるようになる一方で、現実的な関係性自体は模索されている最中であり、明確な形が見えてこないのです。言葉の意味については曖昧な部分が残されているにも関わらず、どうしてこれほどまでに注目が集まっているのでしょうか。これは人間中心のAIという言葉の意味を考えるよりも、この理念の存在意義を理解するほうが状況を把握する近道になります。

まず、人間中心のAIという考え方が生まれた背景には「AIが人間にとってさまざまな不確実性を伴うリスクのある技術である」という懸念があったことが関係しています。

そもそも、AIは人間の知能を再現するために研究されている技術で、人間に匹敵するもの、代わるものとなる可能性を秘めています。それは人間にとって潜在的な「競争相手」になり得るということであり、広く懸念されているような「仕事を奪う」「人間を支配する」といったリスクが決して夢物語ではないことを示しています。

身近なところでは「機械翻訳」や「画像生成」のAIが翻訳家やイラストレーターの脅威となっており、AIの登場によって実際にその活動を諦める人も現れています。こうした懸念が現実となる中で、AIに対する規制が議論されるようになります。その中で人間中心のAIという理念は、今後のAI規制のあり方に大きな影響を与える存在となりました。

AIに対する規制は基本的には国家や組織などの各種共同体によって行われ、規制によってその共同体のAI研究の方向性は大きく変わります。規制が強すぎればAI研究の共同体間のバランスが大きく崩れ、無視できない経済格差や技術格差を生むことになるでしょう。

たとえば、規制だけの影響ではありませんが、ITの世界では米国企業が独占的な立場を確保しており、世界に大きな影響力を持っています。IT以上に高い汎用性を持つAIで同じようなことが起これば、その影響がどこまで及ぶか予想できません。

しかし、規制が弱すぎればAIが人間に大きな不利益をもたらす可能性が高まります。何かのきっかけでAIが大きな問題を起こし、AIに対する社会的なイメージが急激に損なわれれば、規制が強まり、出資が避けられるような形でAIの発展は滞ることになるでしょう。

規制が強すぎることも、弱すぎることも、どちらもAIの発展を考える上では望ましくないのです。こうしたAIに対する規制や社会的な扱い方を考えるための根幹となる理念として生まれたのが人間中心のAIというわけです。

【次ページ】内閣府が提唱する 「人間中心のAI社会原則」とは

AI・生成AIのおすすめコンテンツ

AI・生成AIの関連コンテンツ

PR

PR

PR