- 会員限定

- 2023/03/27 掲載

説明可能AI(XAI:Explainable AI)とは? 仕組み・活用メリット・活用例をわかりやすく解説

合同会社Noteip代表。ライター。米国の大学でコンピューターサイエンスを専攻し、卒業後は国内の一部上場企業でIT関連製品の企画・マーケティングなどに従事。退職後はライターとして書籍や記事の執筆、WEBコンテンツの制作に関わっている。人工知能の他に科学・IT・軍事・医療関連のトピックを扱っており、研究機関・大学における研究支援活動も行っている。著書『近未来のコア・テクノロジー(翔泳社)』『図解これだけは知っておきたいAIビジネス入門(成美堂)』、執筆協力『マンガでわかる人工知能(池田書店)』など。

説明可能AIとは

説明可能AI(XAI:Explainable AI)とは、AIの判断や予測に関する思考プロセスやアルゴリズムが(人間にも分かる形で)説明できるAI、また説明を可能にする技術のことを指します。この説明可能AIは、AIの思考プロセスやアルゴリズムが説明できるという「AIの特性」を指す言葉として使われることもあれば、「特定の技術分野」を指す言葉としても使われることがあり、文脈によって若干意味が異なります。

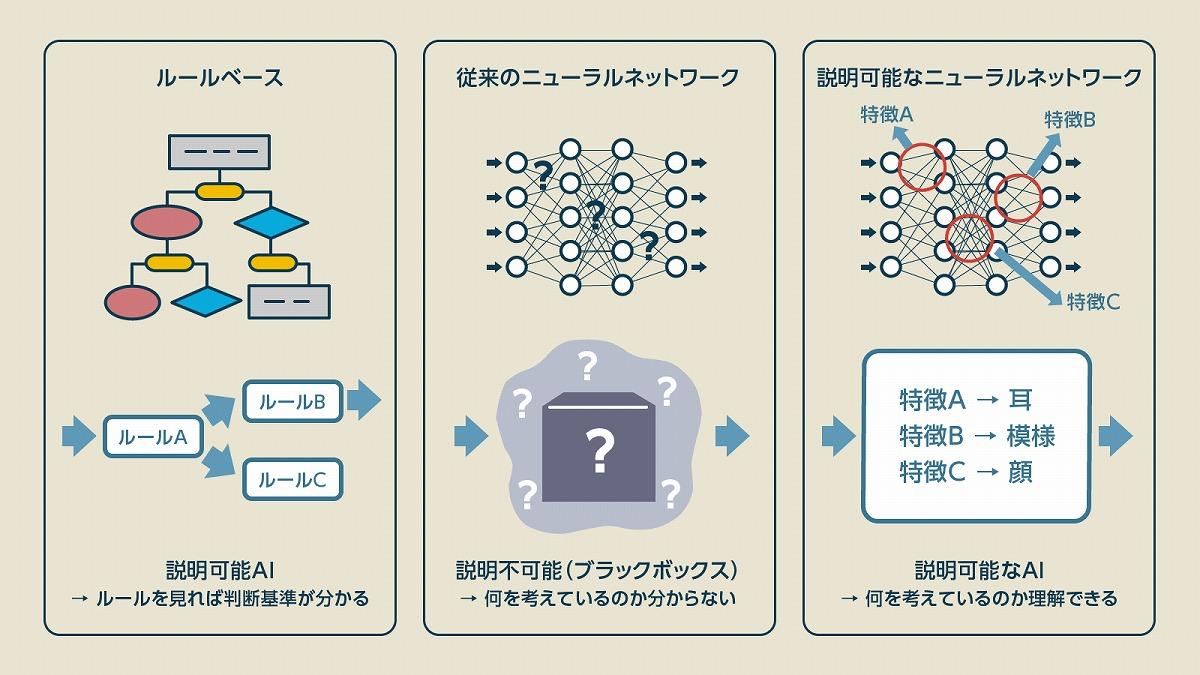

たとえば、古典的なルールベースで判断を行うAIや、綺麗な数式を用いて予測を行うAIなどは、思考プロセスや判断基準が明確であるため、AIの特性として「説明可能AI」と言うことができます。

ただし、この場合は「AIの思考を説明するための技術」が使われているわけではなく、元々の仕組みとして思考が分かりやすいということになります。この場合、技術的な高度さよりも、透明性の高い「責任あるAI」の一部としての説明可能AIと言えるでしょう。

一方、ブラックボックス化しているニューラルネットワークの思考プロセスは、ニューラルネットワークの内部で何が起きているのか分析し、理解できるようにする仕組みがなければ理解することはできません。一般的に説明可能AIの技術的な側面について議論される場合は、ニューラルネットワーク型のAIにおける技術の一部として扱われます。

AIの判断の根拠を説明できると、どんなメリットがある?

そうした説明可能AIを用いることで、人間はAIの思考プロセスを理解することができるようになります。たとえば、猫の画像認識をするAIがあったとして、どうやって猫を見分けているかという思考プロセスについて、説明可能AIであれば、「耳」「模様」「顔」が特定の猫の画像の特徴と合致したから猫と判断した、という判断基準を明確に示すことができます。ここで特に重要なのが判断基準を明確にすることで、耳や顔の情報は判断には必要不可欠といった「判断の境界線を明示できる」という点です。

つまり「これがあるから猫」「これがないから猫ではない」といった判断のボーダーラインが明示することができるAIであれば、人間の判断基準との差異が明確になり、そのAIの調整や検証が容易になります。

説明可能AIの活用イメージ

こうした説明可能AIの特性は、医療・金融・製造分野のような小さな判断ミスが大きな影響を与えるような分野では特に有用で、AIの判断について詳しく検証できれば難しい判断にも使えるようになりAIの精度向上につなげられるほか、責任領域が明確になるという点でも大きなメリットがあります。たとえば、「99.9%の確率で正しい判断を行うAI」を利用するケースを考えてみましょう。判断根拠を明確にできる説明可能AIがミスを犯すケースと、説明できないブラックボックスAIがミスを犯すケースでは、責任の所在が大きく異なります。

判断の根拠をAIが明確に説明している場合、ユーザーはAIのミスに気づくことができるはずであり、それができなかったのはユーザーの落ち度となるでしょう。しかし、説明ができないAIを利用している場合には、滅多にミスをしないAIのミスにユーザーが気づくことは難しく、不具合の原因によっては開発者側が責任を負わざるを得ないケースも出てきます。

こうした点からも、説明可能AIは人間とAIが共存していく「人間中心のAI」やAIの運用に責任を持つ「責任あるAI」を実現する上では必要不可欠な技術と言えるでしょう。

そんな説明可能AIですが、どのような条件がそろっていれば「これは説明可能AIだ」と言えることができるのでしょうか。説明できる、とはどのレベルを指すのでしょうか。 【次ページ】どんな要素があれば「説明可能AI」と言える? 4原則を解説

AI・生成AIのおすすめコンテンツ

AI・生成AIの関連コンテンツ

PR

PR

PR