- 会員限定

- 2016/12/21 掲載

慶応大 新保史生 教授が語る「ロボット法整備」の重要性、AI普及の前に何をすべきか

主に技術系の書籍を中心に企画・編集に携わる。2013年よりフリーランスで活動をはじめる。IT関連の技術・トピックから、デバイス、ツールキット、デジタルファブまで幅広く執筆活動を行う。makezine.jpにてハードウェアスタートアップ関連のインタビューを、livedoorニュースにてニュースコラムを好評連載中。CodeIQ MAGAZINEにも寄稿。著書に『ハッカソンの作り方』(BNN新社)、共編著に『オウンドメディアのつくりかた』(BNN新社)および『エンジニアのためのデザイン思考入門』(翔泳社)がある。

総合政策学部

教授

新保史生 氏

ロボット法整備「何を議論すべきか」を議論せよ

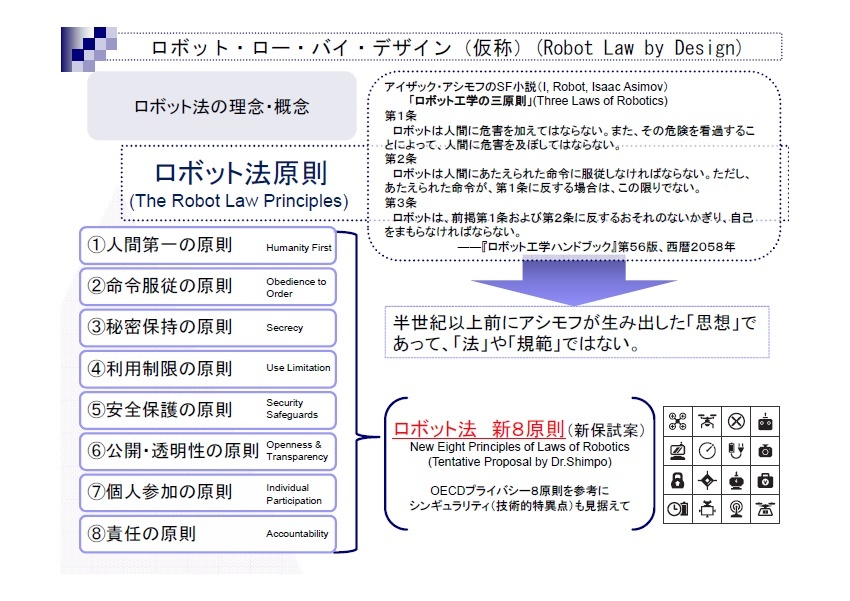

すでに言われていることだが、自律型ロボットやAIが我々の生活の中で普及していくうえで社会的インフラの整備は不可欠だ。テクノロジーとの共存のための社会的に解決しなければならない問題を指摘するのが、デジタルハリウッド主催イベント「近未来教育フォーラム2016」に登壇した慶應義塾大学 総合政策学部 教授 新保史生 氏である。同氏は、戦略実現のための組織として設立された「ロボット革命イニシアティブ協議会」をはじめ数々の委員会に所属し、AIやロボットの活用にあたって起こり得る法的課題を把握し、安全、安心な利用環境を整備する活動を行っている。そんな同氏が、2015年10月に発表したのが「ロボット法 新8原則」だ。

(1)人間第一の原則

(2)命令服従の原則

(3)秘密保持の原則

(4)利用制限の原則

(5)安全保護の原則

(6)公開・透明性の原則

(7)個人参加の原則

(8)責任の原則

新保氏はこの原則について「よい悪いではなく、AI・ロボット・IoTをセットにして共通の認識に則ってみんなで共存を考えていくということを目指したもの」と説明する。

1950年、SF作家のアイザック・アシモフが著作『われはロボット』の中で発表した「ロボット工学三原則」という思想がある。しかし新保氏は「これはあくまで思想であり、現代においては『法、規範』として効力を有するものが必要だ」と主張する。

ロボット大国の地位を維持するために法整備が必要

ドローンにしても掃除ロボットにしても日本製が増えてきているが、いまだに海外メーカー製のものを使っている人が非常に多い。スマートフォンをはじめとして、使われている部品は日本製が多いのに、実際にそれらを完成品として売り出すのは海外のメーカーばかりだ。

「たとえば原発事故の際、最初に投入されたのは日本のロボットではなくiRobot社のパックボット(PackBot)というロボットだった。このように、技術では決して負けていないのにビジネスで負けるということが繰り返されている」(新保氏)

AI×IoT時代に社会的な課題をどう捉えていくか

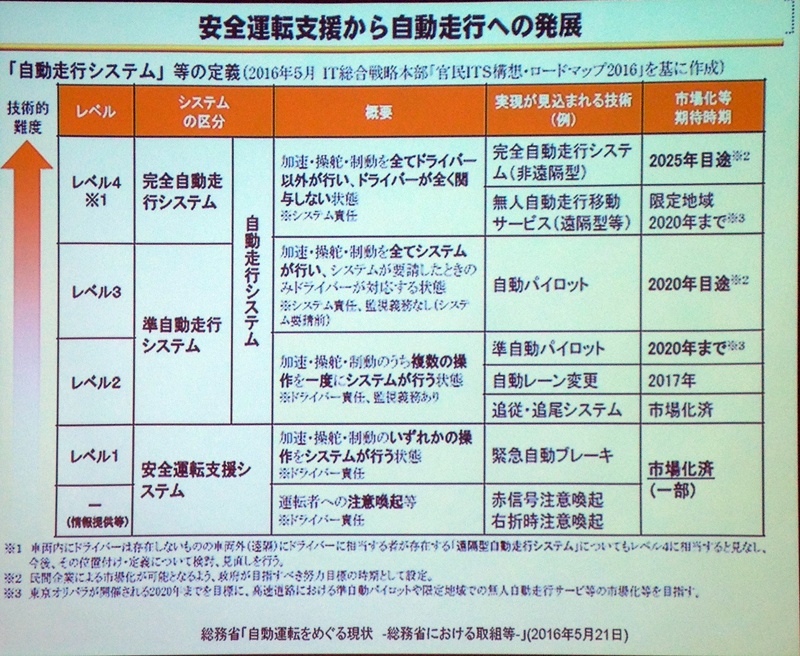

新保氏はこの要因の一つとして「ロボットやAIに関係するさまざまな法的課題について十分に議論されていない」という状況を挙げている。たとえば今後普及するであろうと言われている自動運転についてだ。自動運転の自動車が普及するときに何を検討し、解決しなければならないのか。個別にさまざまな問題があるはずだが、それらが体系的に把握されていないという。

「もし、自動運転中に事故が起きたら誰がどういう責任を負うのか。たとえば、レベル4の完全自動運転は、自動車単体の機能というより、自動走行システムのような複合的なシステムが必要になる。地図や環境側のデータとマッピングして、目的地まで自動運転する。自動車そのものの機能が何らかのトラブルで事故を起こしたとすれば、製造物責任を問えるだろう。しかし、データのほうに問題があった場合はどうだろうか。おそらくクラウドに集積されたデータを利用することになり、そうした場合のデータの管理はどうすればいいのか。単独の誰かに対して、責任を問えるものなのだろうか」(新保氏)

【次ページ】AIが起こしたトラブルは誰が責任を取るべきか

AI・生成AIのおすすめコンテンツ

AI・生成AIの関連コンテンツ

PR

PR

PR